当前位置:网站首页>机器学习 三: 基于逻辑回归的分类预测

机器学习 三: 基于逻辑回归的分类预测

2022-04-23 06:10:00 【Amyniez】

1 逻辑回归的介绍和应用

1.1 逻辑回归的介绍

逻辑回归(Logistic regression,简称LR)虽然其中带有"回归"两个字,但逻辑回归其实是一个分类模型,并且广泛应用于各个领域之中。虽然现在深度学习相对于这些传统方法更为火热,但实则这些传统方法由于其独特的优势依然广泛应用于各个领域中。

而对于逻辑回归而且,最为突出的两点就是其模型简单和模型的可解释性强。

逻辑回归模型的优劣势:

- 优点: 实现简单,易于理解和实现;计算代价不高,速度很快,存储资源低;

- 缺点: 容易欠拟合,分类精度可能不高

1.1 逻辑回归的应用

逻辑回归模型广泛用于各个领域,包括机器学习,大多数医学领域和社会科学。例如,最初由Boyd 等人开发的创伤和损伤严重度评分(TRISS)被广泛用于预测受伤患者的死亡率,使用逻辑回归 基于观察到的患者特征(年龄,性别,体重指数,各种血液检查的结果等)分析预测发生特定疾病(例如糖尿病,冠心病)的风险。逻辑回归模型也用于预测在给定的过程中,系统或产品的故障的可能性。还用于市场营销应用程序,例如预测客户购买产品或中止订购的倾向等。在经济学中它可以用来预测一个人选择进入劳动力市场的可能性,而商业应用则可以用来预测房主拖欠抵押贷款的可能性。条件随机字段是逻辑回归到顺序数据的扩展,用于自然语言处理。

逻辑回归模型现在同样是很多分类算法的基础组件,比如 分类任务中基于GBDT算法+LR逻辑回归实现的信用卡交易反欺诈,CTR(点击通过率)预估等,其好处在于输出值自然地落在0到1之间,并且有概率意义。模型清晰,有对应的概率学理论基础。它拟合出来的参数就代表了每一个特征(feature)对结果的影响。也是一个理解数据的好工具。但同时由于其本质上是一个线性的分类器,所以不能应对较为复杂的数据情况。很多时候我们也会拿逻辑回归模型去做一些任务尝试的基线baseline(基础水平)。

4.1 Demo

Step1: 库函数导入

- 注释: Seaborn是在matplotlib的基础上进行了更高级的API封装,从而使得作图更加容易,在大多数情况下使用seaborn就能做出很具有吸引力的图。如,

- 1.set_style( )用来设置主题;

- 2.distplot( )为hist加强版、kdeplot( )为密度曲线图 ;

- 3.箱型图 boxplot( ):最大的优点是不受异常值的影响,可以以一种相对稳定的方式描述数据的离散分布情况;

- 4.联合分布jointplot( )

- 5.热点图heatmap( )

# 基础函数库

import numpy as np

# 导入画图库

import matplotlib.pyplot as plt

import seaborn as sns

# 导入逻辑回归模型函数

from sklearn.linear_model import LogisticRegression

Step2: 模型训练

# 构造数据集

x_fearures = np.array([[-1, -2], [-2, -1], [-3, -2], [1, 3], [2, 1], [3, 2]])

y_label = np.array([0, 0, 0, 1, 1, 1])

# 调用逻辑回归模型

lr_clf = LogisticRegression()

# 用逻辑回归模型拟合构造的数据集

lr_clf = lr_clf.fit(x_fearures, y_label) #其拟合方程为y=w0+w1*x1+w2*x2,w为权重,w0为偏移或者误差值

Step3: 模型参数查看

# 查看其对应模型的w

# coef_:“斜率”参数(w,也叫作权重)

print('the weight of Logistic Regression:',lr_clf.coef_)

# 查看其对应模型的w0

# intercept_ :偏移或截距(b)

print('the intercept(w0) of Logistic Regression:',lr_clf.intercept_)

结果:

the weight of Logistic Regression: [[0.73462087 0.6947908 ]]

the intercept(w0) of Logistic Regression: [-0.03643213]

Step4: 数据和模型可视化

# 可视化构造的数据样本点

plt.figure()

#散点图

plt.scatter(x_fearures[:,0],x_fearures[:,1], c=y_label, s=50, cmap='viridis')

plt.title('Dataset')

plt.show()

# 可视化决策边界

plt.figure()

plt.scatter(x_fearures[:,0],x_fearures[:,1], c=y_label, s=50, cmap='viridis')

plt.title('Dataset')

nx, ny = 200, 100

#设置图像的界限limit,即最大值和最小值

x_min, x_max = plt.xlim()

y_min, y_max = plt.ylim()

x_grid, y_grid = np.meshgrid(np.linspace(x_min, x_max, nx),np.linspace(y_min, y_max, ny))

z_proba = lr_clf.predict_proba(np.c_[x_grid.ravel(), y_grid.ravel()])

z_proba = z_proba[:, 1].reshape(x_grid.shape)

plt.contour(x_grid, y_grid, z_proba, [0.5], linewidths=2., colors='blue')

plt.show()

可视化预测新样本:

plt.figure()

# new point 1

x_fearures_new1 = np.array([[0, -1]])

plt.scatter(x_fearures_new1[:,0],x_fearures_new1[:,1], s=50, cmap='viridis')

# annotate注释

# 用文本文本注释点x、y;

# 通过定义*arrowprops*(箭头道具)添加

plt.annotate(s='New point 1',xy=(0,-1),xytext=(-2,0),color='blue',arrowprops=dict(arrowstyle='-|>',connectionstyle='arc3',color='red'))

# new point 2

x_fearures_new2 = np.array([[1, 2]])

plt.scatter(x_fearures_new2[:,0],x_fearures_new2[:,1], s=50, cmap='viridis')

plt.annotate(s='New point 2',xy=(1,2),xytext=(-1.5,2.5),color='red',arrowprops=dict(arrowstyle='-|>',connectionstyle='arc3',color='red'))

# 训练样本

plt.scatter(x_fearures[:,0],x_fearures[:,1], c=y_label, s=50, cmap='viridis')

plt.title('Dataset')

# 可视化决策边界

plt.contour(x_grid, y_grid, z_proba, [0.5], linewidths=2., colors='blue')

plt.show()

Step5: 模型预测

# 在训练集和测试集上分别利用训练好的模型进行预测

y_label_new1_predict = lr_clf.predict(x_fearures_new1)

y_label_new2_predict = lr_clf.predict(x_fearures_new2)

print('The New point 1 predict class:\n',y_label_new1_predict)

print('The New point 2 predict class:\n',y_label_new2_predict)

# 由于逻辑回归模型是概率预测模型(前文介绍的 p = p(y=1|x,\theta)),所以可以利用 predict_proba 函数预测其概率

y_label_new1_predict_proba = lr_clf.predict_proba(x_fearures_new1)

y_label_new2_predict_proba = lr_clf.predict_proba(x_fearures_new2)

print('The New point 1 predict Probability of each class:\n',y_label_new1_predict_proba)

print('The New point 2 predict Probability of each class:\n',y_label_new2_predict_proba)

The New point 1 predict class:

[0]

The New point 2 predict class:

[1]

The New point 1 predict Probability of each class:

[[0.67507358 0.32492642]]

The New point 2 predict Probability of each class:

[[0.11029117 0.88970883]]

可以发现训练好的回归模型将X_new1预测为了类别0(判别面左下侧),X_new2预测为了类别1(判别面右上侧)。其训练得到的逻辑回归模型的概率为0.5的判别面为上图中蓝色的线。

版权声明

本文为[Amyniez]所创,转载请带上原文链接,感谢

https://blog.csdn.net/amyniez/article/details/124345454

边栏推荐

- ViewPager2实现画廊效果执行notifyDataSetChanged后PageTransformer显示异常 界面变形问题

- npm ERR code 500解决

- ffmpeg常用命令

- Component learning (2) arouter principle learning

- BottomSheetDialogFragment 与 ListView RecyclerView ScrollView 滑动冲突问题

- Tiny4412 HDMI display

- 【2021年新书推荐】Red Hat RHCSA 8 Cert Guide: EX200

- Encapsulate a set of project network request framework from 0

- 窗口分析函数LAST_VALUE,FIRST_VALUE,lag,lead

- Markdown basic grammar notes

猜你喜欢

Ffmpeg common commands

组件化学习(2)Arouter原理学习

Record WebView shows another empty pit

记录webView显示空白的又一坑

Viewpager2 realizes Gallery effect. After notifydatasetchanged, pagetransformer displays abnormal interface deformation

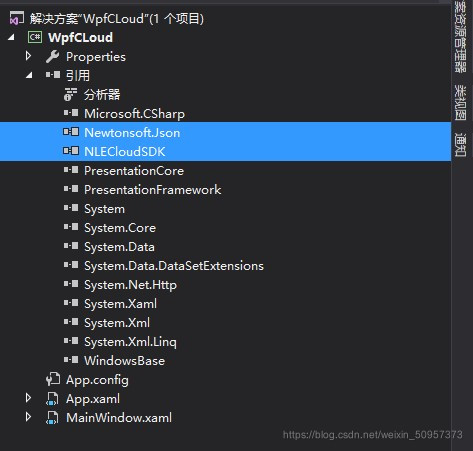

C#新大陆物联网云平台的连接(简易理解版)

【2021年新书推荐】Learn WinUI 3.0

【2021年新书推荐】Kubernetes in Production Best Practices

Google AdMob advertising learning

C# EF mysql更新datetime字段报错Modifying a column with the ‘Identity‘ pattern is not supported

随机推荐

DCMTK(DCM4CHE)与DICOOGLE协同工作

ffmpeg常用命令

【2021年新书推荐】Artificial Intelligence for IoT Cookbook

MySQL笔记3_约束_主键约束

组件化学习(3)ARouter中的Path和Group注解

[多屏互动] 实现双多屏异显二:startActivity方式

Oracle索引状态查询与索引重建

AVD Pixel_ 2_ API_ 24 is already running. If that is not the case, delete the files at C:\Users\admi

org.xml.sax.SAXParseException; lineNumber: 141; columnNumber: 252; cvc-complex-type.2.4.a: 发现了以元素 ‘b

Itop4412 kernel restarts repeatedly

oracle杀死正在执行的sql

实习做了啥

JVM basics you should know

Recyclerview 批量更新View:notifyItemRangeInserted、notifyItemRangeRemoved、notifyItemRangeChanged

cmder中文乱码问题

Cause: dx. jar is missing

iTOP4412 LCD背光驱动(PWM)

去掉状态栏

Miscellaneous learning

sys.dbms_scheduler.create_job创建定时任务(功能更强大丰富)