当前位置:网站首页>训练分类器

训练分类器

2022-08-11 05:33:00 【我是无名的我】

进行一下学习的记录,对自己不懂的地方加以注释。

参考pytorch中文教程

1.加载并标准化CIFAR10

使用torchvision加载CIFAR10超级简单。

import torch

import torchvision #torchvision是独立于pytorch的关于图像操作的一些方便工具库。

import torchvision.transforms as transforms #常用的图像操作,例如:随机切割,旋转,数据类型转换,图像到tensor ,numpy 数组到tensor , tensor 到 图像等。

torchvision数据集加载完后的输出是范围在[0, 1]之间的PILImage。我们将其标准化为范围在[-1, 1]之间的张量。

transform = transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))])

#transforms.Compose 把多个转换步骤整合到一起

#transforms.ToTensor 将PIL图像或者numpy.ndarray转化为tensor

#transforms.Normalize 用平均值和标准差归一化量张图像

trainset = torchvision.datasets.CIFAR10(root='./data', train=True, download=True, transform=transform)

#CIFAR10数据集

trainloader = torch.utils.data.DataLoader(trainset, batch_size=4, shuffle=True, num_workers=2)

#用于数据的加载

#batch_size=4 批次大小

#shuffle=True 打乱数据集

#num_workers=2子进程数目

testset = torchvision.datasets.CIFAR10(root='./data', train=False, download=True, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=4, shuffle=False, num_workers=2)

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')

乐趣所致,现在让我们可视化部分训练数据。

import matplotlib.pyplot as plt

import numpy as np

# 输出图像的函数

def imshow(img):

img = img / 2 + 0.5 # unnormalize

npimg = img.numpy()

plt.imshow(np.transpose(npimg, (1, 2, 0)))

plt.show()

# 随机获取训练图片

dataiter = iter(trainloader)

images, labels = dataiter.next()

# 显示图片

imshow(torchvision.utils.make_grid(images))

# 打印图片标签

print(' '.join('%5s' % classes[labels[j]] for j in range(4)))

2.定义卷积神经网络

import torch.nn as nn

import torch.nn.functional as F

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()

3.定义损失函数和优化器

import torch.optim as optim

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)

4.训练网络

for epoch in range(2): # loop over the dataset multiple times

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

''' 遍历数据,从0开始。 seasons = ['Spring', 'Summer', 'Fall', 'Winter'] for i, j in enumerate(seasons, 0): print(i, j) 0 Spring 1 Summer 2 Fall 3 Winter '''

# get the inputs

inputs, labels = data

# zero the parameter gradients

optimizer.zero_grad()

# forward + backward + optimize

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# print statistics

running_loss += loss.item()

if i % 2000 == 1999: # print every 2000 mini-batches

print('[%d, %5d] loss: %.3f' % (epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')

5.使用测试数据测试网络

我们已经在训练集上训练了2遍网络。但是我们需要检查网络是否学到了一些东西。

我们将通过预测神经网络输出的标签来检查这个问题,并和正确样本进行(ground-truth)对比。如果预测是正确的,我们将样本添加到正确预测的列表中。

ok,第一步。让我们显示测试集中的图像来熟悉一下。

dataiter = iter(testloader)

images, labels = dataiter.next()

# 输出图片

imshow(torchvision.utils.make_grid(images))

print('GroundTruth: ', ' '.join('%5s' % classes[labels[j]] for j in range(4)))

ok,现在让我们看看神经网络认为上面的例子是:

outputs = net(images)

输出是10个类别的量值。一个类的值越高,网络就越认为这个图像属于这个特定的类。让我们得到最高量值的下标/索引;

_, predicted = torch.max(outputs, 1)

#torch.max(a,1) 返回每一行中最大值的那个元素,且返回其索引(返回最大元素在这一行的列索引)

print('Predicted: ', ' '.join('%5s' % classes[predicted[j]] for j in range(4)))

结果还不错。

让我们看看网络在整个数据集上表现的怎么样。

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))

这比随机选取(即从10个类中随机选择一个类,正确率是10%)要好很多。看来网络确实学到了一些东西。

那么哪些是表现好的类呢?哪些是表现的差的类呢?

class_correct = list(0. for i in range(10))

class_total = list(0. for i in range(10))

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs, 1)

c = (predicted == labels).squeeze()

for i in range(4):

label = labels[i]

class_correct[label] += c[i].item()

class_total[label] += 1

for i in range(10):

print('Accuracy of %5s : %2d %%' % (

classes[i], 100 * class_correct[i] / class_total[i]))

边栏推荐

猜你喜欢

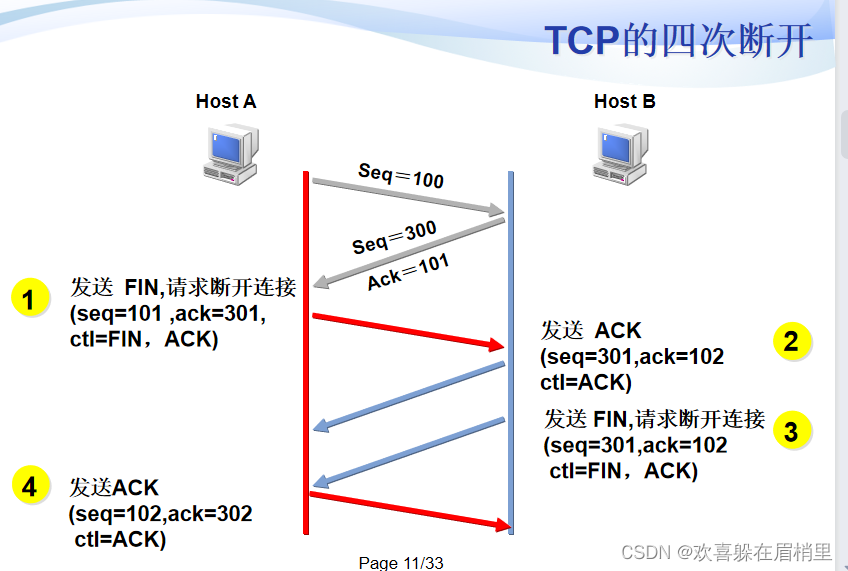

TCP 三次握手、四次断开

项目笔记——随机2

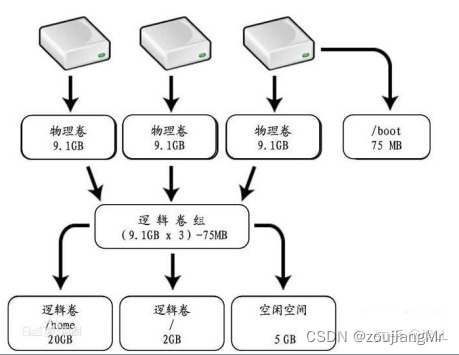

lvm 多盘挂载,合并使用

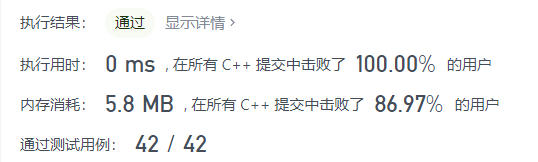

【LeetCode】306.累加数(思路+题解)

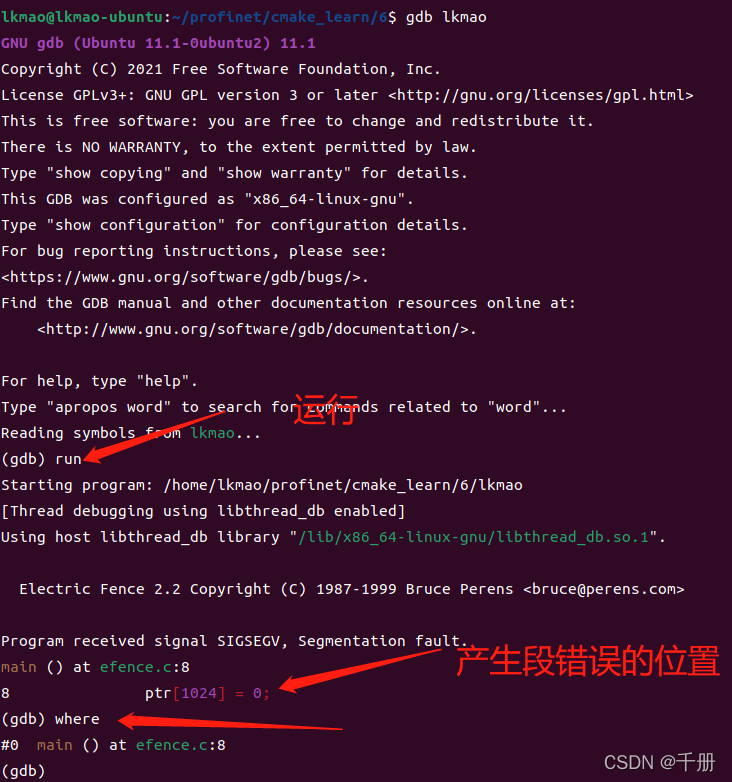

Memory debugging tools Electric Fence

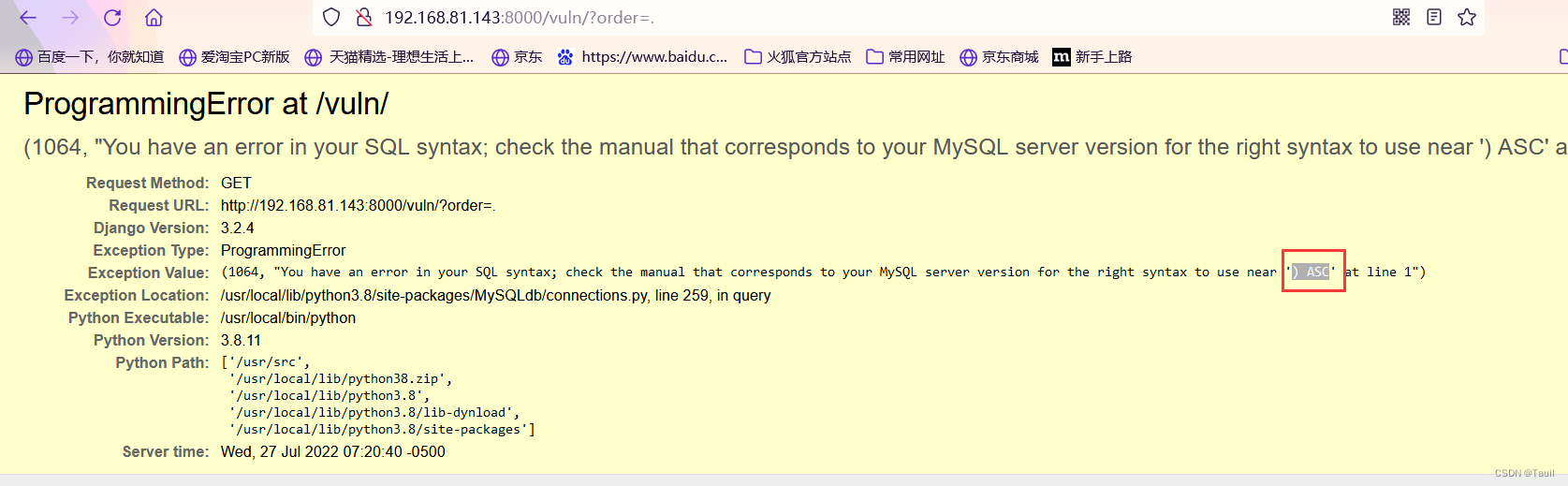

Django QuerySet.order_by() SQL注入漏洞复现

CLUSTER DAY03( Ceph概述 、 部署Ceph集群 、 Ceph块存储)

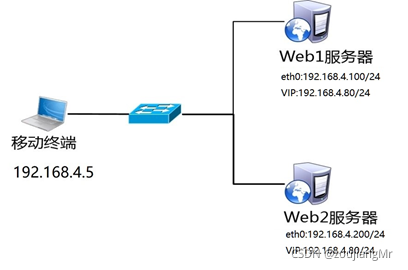

CLUSTER DAY02( Keepalived热备 、 Keepalived+LVS 、 HAProxy服务器 )

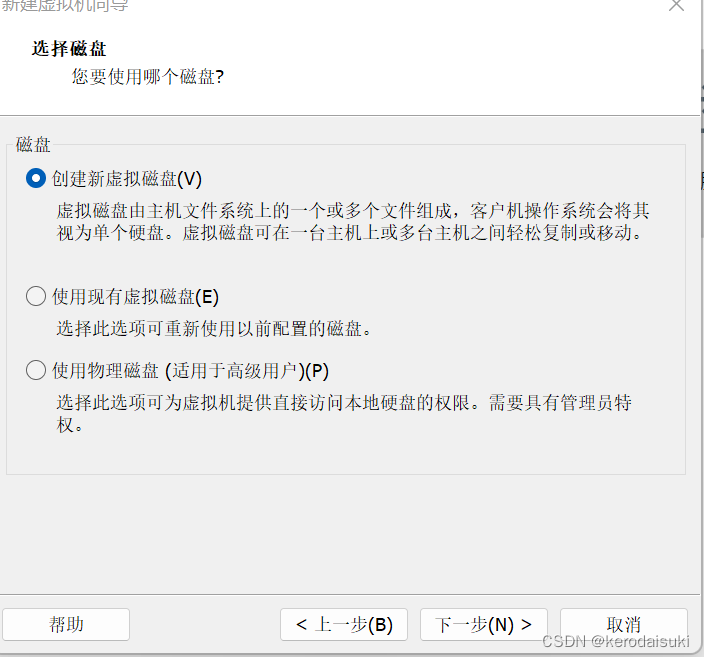

VMware workstation 16 安装与配置

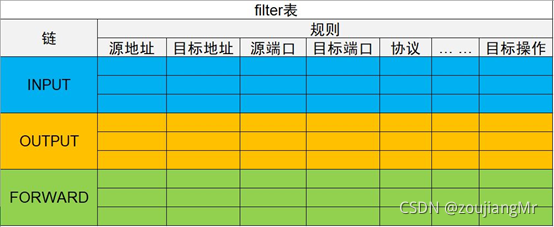

SECURITY DAY06( iptables防火墙 、 filter表控制 、 扩展匹配、nat表典型应用 )

随机推荐

Slurm基本使用

无胁科技-TVD每日漏洞情报-2022-7-26

Memory debugging tools Electric Fence

Threatless Technology-TVD Daily Vulnerability Intelligence-2022-7-26

vnc远程桌面安装(2021-10-20日亲测可用)

ETCD单节点故障应急恢复

Vulnhub靶机--born2root

AUTOMATION DAY07( Ansible Vault 、 普通用户使用ansible)

SECURITY DAY06( iptables防火墙 、 filter表控制 、 扩展匹配、nat表典型应用 )

项目笔记——随机2

MySQl进阶之索引结构

SECURITY DAY01(监控概述 、 Zabbix基础 、 Zabbix监控服 )

SECURITY DAY04 (Prometheus server, Prometheus monitored terminal, Grafana, monitoring database)

ovnif摄像头修改ip

Vulnhub靶机--DC7

MySQL中忘记用户密码怎么办?

lvm 多盘挂载,合并使用

Threatless Technology-TVD Daily Vulnerability Intelligence-2022-7-27

项目笔记——随记

cloudreve使用体验