当前位置:网站首页>[损失函数]——均方差

[损失函数]——均方差

2022-08-11 05:35:00 【Pr4da】

1. 均方差损失函数(Mean Squared Error, MSE)

均方差损失函数是预测数据和原始数据对应点误差的平方和的均值,公式为:

M S E = 1 N ( y ^ − y ) 2 MSE = \frac{1}{N}(\hat{y}-y)^{2} MSE=N1(y^−y)2

N为样本个数。

2. 均方差在pytorch中的用法

均方差损失函数在pytorch中的函数为:

torch.nn.MSELoss(size_average=None, reduce=None, reduction='mean')

pytorch中默认损失计算的是均值。

我看很多博客对该损失函数讲解的不是很全面,它们只告诉你这个接口怎么用而不讲解其中是怎么进行运算的,下面我用一个实例来讲解一下函数内部是如何运算的。

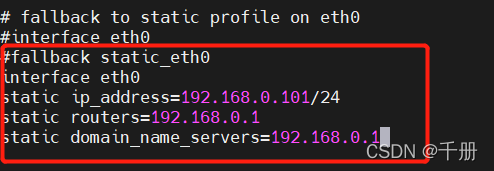

>>> input = torch.randn(3,5,requires_grad=True)

>>> input

tensor([[ 0.0107, 0.0574, 0.2145, -0.6022, -0.2549],

[-0.5236, -0.0693, 0.4386, 0.1597, 2.2749],

[-1.7281, -0.6220, 2.5002, -0.5681, -0.5767]], requires_grad=True)

>>> target = torch.randn(3,5)

>>> target

tensor([[ 0.3699, -0.7985, 1.2310, 0.3084, 2.2067],

[ 0.2520, -1.0720, 0.1930, -0.2715, 0.7808],

[-0.9800, -1.0310, -1.2699, -0.9418, -1.2091]])

>>> loss = nn.MSELoss()

>>> output = loss(input, target)

>>> output.backward()

>>> output

tensor(1.8899, grad_fn=<MseLossBackward>)

计算得到input和target的均方差为2.3449。下面我们不借助torch.nn.MESLoss()来计算下它们的均方差。

首先根据公式我们要计算input和target的差的平方:

>>> result = (input-output)**2

>>> result

tensor([[ 0.1290, 0.7326, 1.0333, 0.8291, 6.0594],

[ 0.6015, 1.0054, 0.0603, 0.1860, 2.2324],

[ 0.5596, 0.1673, 14.2134, 0.1397, 0.3998]], grad_fn=<PowBackward0>)

接着我们求result所有元素的和,然后再除以元素总个数15:

>>> result = result.view(15,).sum()/15

>>> result

tensor(1.8899, grad_fn=<DivBackward0>)

和nn.MSELoss()计算结果相同。

值得注意的是,若多分类任务中要使用均方差作为损失函数,需要将标签转换成one-hot形式,这与交叉熵损失函数恰巧相反。关于交叉熵如何使用可以参考我的另一篇博客:[损失函数]——交叉熵。

因为在使用nn.CrossEntropyLoss()时是取出激活层输出中每个样本( 每一行)中最大的数参与损失函数的运算,而均方差则不然,它是对每一个输出都要参与运算,所以在使用均方差作为损失函数的时候要将标签转换成one-hot形式。

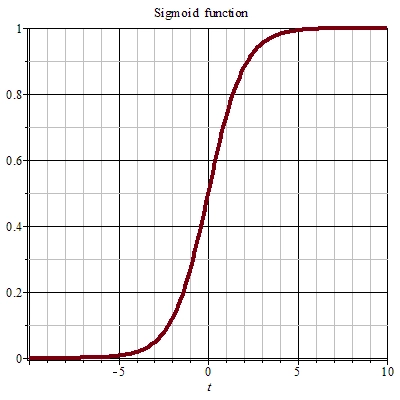

3. 均方差不宜和sigmoid函数一起使用

下面用公式来进行说明:

sigmoid的函数如下:

S ( x ) = 1 1 + e − x S(x)=\frac{1}{1+e^{-x}} S(x)=1+e−x1

均方差损失函数:

L o s s = 1 N ( y ^ − y ) 2 = 1 N ( S ( ω ∗ x + b ) − y ) 2 Loss = \frac{1}{N}(\hat{y}-y)^{2} =\frac{1}{N}(S(\omega *x +b)-y)^2 Loss=N1(y^−y)2=N1(S(ω∗x+b)−y)2

对权值求导 ω \omega ω:

∂ L o s s ∂ ω = 2 N ( S ( ω ∗ x + b ) − y ) S ′ ( ω ∗ x + b ) \frac{\partial Loss}{\partial \omega }=\frac{2}{N}(S(\omega *x +b)-y){S}'(\omega *x +b) ∂ω∂Loss=N2(S(ω∗x+b)−y)S′(ω∗x+b)

最终变换成对sigmoid函数求导,sigmoid函数有一个特点,那就是横坐标越远离坐标原点,导数越接近于0,当 S ( ω ∗ x + b ) S(\omega *x +b) S(ω∗x+b)越接近1时导数越小,最终会造成梯度消失。

pytorch官方文档

交叉熵损失函数(Cross Entropy Error Function)与均方差损失函数(Mean Squared Error)

边栏推荐

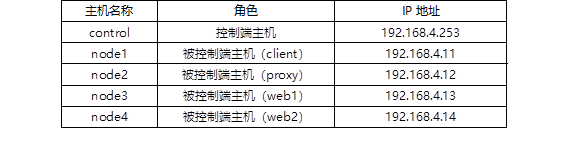

- CLUSTER DAY01(集群及LVS简介 、 LVS-NAT集群 、 LVS-DR集群)

- SECURITY DAY02 (Zabbix alarm mechanism, Zabbix advanced operation and monitoring case)

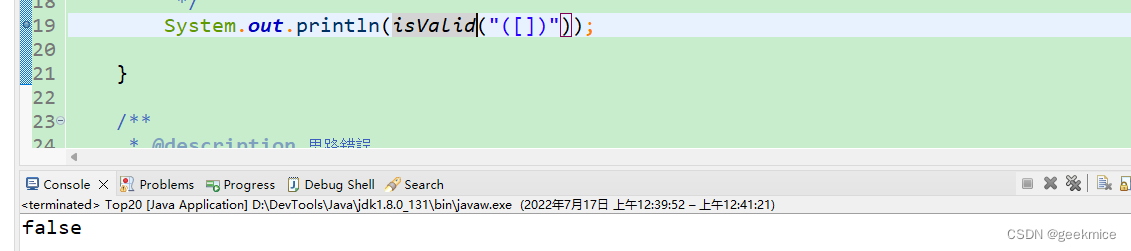

- Top20 bracket matching

- AUTOMATION DAY06 (Ansible Advanced, Ansible Role)

- 中国移动通信集团有限公司:业务委托书

- iptables 使用脚本来管理规则

- Threatless Technology-TVD Daily Vulnerability Intelligence-2022-7-18

- 从mask-rcnn到shp

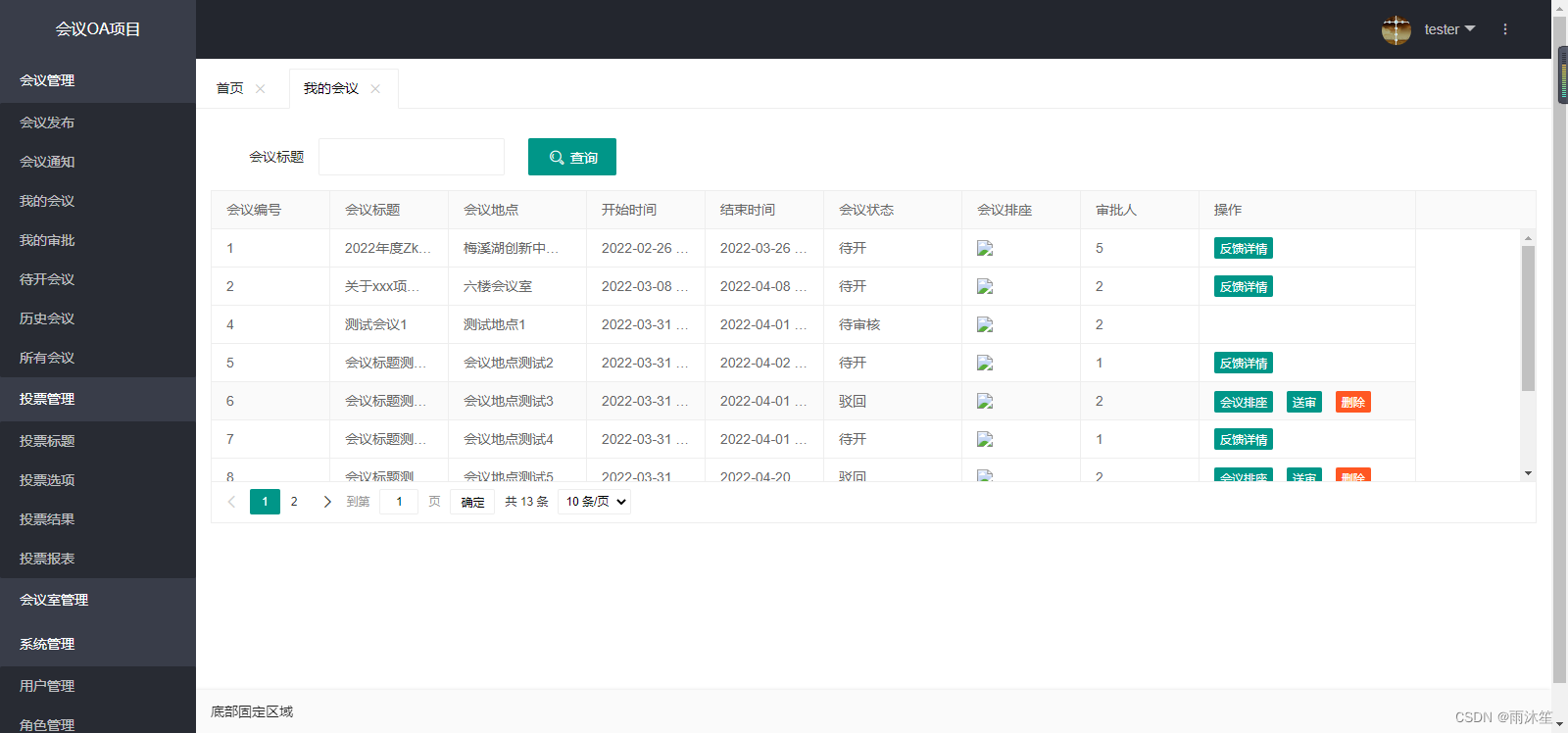

- OA项目之待开会议&历史会议&所有会议

- OA项目之我的会议(会议排座&送审)

猜你喜欢

随机推荐

HCIP-生成树(802.1D ,标准生成树/802.1W : RSTP 快速生成树/802.1S : MST 多生成树)

ETCD cluster fault emergency recovery - local data is available

推荐一个好用的IDEA插件---Translation—中英互译

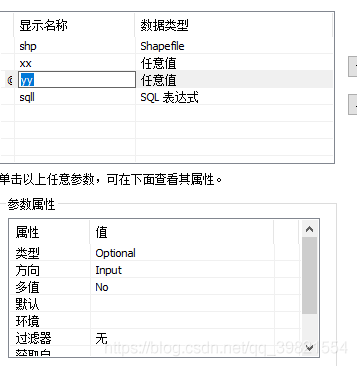

arcmap下的多进程脚本

HCIP MPLS/BGP综合实验

No threat of science and technology - TVD vulnerability information daily - 2022-7-21

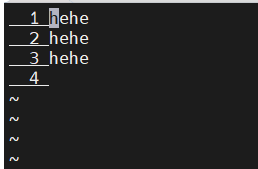

vi display line number in buildroot embedded file system

lvm 多盘挂载,合并使用

MySQL导入导出&视图&索引&执行计划

iptables的状态

HCIA实验

Memory debugging tools Electric Fence

中国移动通信集团有限公司:业务委托书

阿里巴巴规范之POJO类中布尔类型的变量都不要加is前缀详解

ETCD cluster fault emergency recovery - to recover from the snapshot

MySQl进阶之索引结构

HCIA知识复习

知识蒸馏Knownledge Distillation

ETCD Single-Node Fault Emergency Recovery

deepin v20.6+cuda+cudnn+anaconda(miniconda)