当前位置:网站首页>神经网络参数如何确定的,神经网络参数个数计算

神经网络参数如何确定的,神经网络参数个数计算

2022-08-11 09:24:00 【阳阳2013哈哈】

神经网络权值怎么确定?

神经网络的权值是通过对网络的训练得到的。如果使用MATLAB的话不要自己设定,newff之后会自动赋值。也可以手动:{}=;{}=。一般来说输入归一化,那么w和b取0-1的随机数就行。

神经网络的权值确定的目的是为了让神经网络在训练过程中学习到有用的信息,这意味着参数梯度不应该为0。

参数初始化要满足两个必要条件:1、各个激活层不会出现饱和现象,比如对于sigmoid激活函数,初始化值不能太大或太小,导致陷入其饱和区。

2、各个激活值不为0,如果激活层输出为零,也就是下一层卷积层的输入为零,所以这个卷积层对权值求偏导为零,从而导致梯度为0。扩展资料:神经网络和权值的关系。

在训练智能体执行任务时,会选择一个典型的神经网络框架,并相信它有潜力为这个任务编码特定的策略。注意这里只是有潜力,还要学习权重参数,才能将这种潜力变化为能力。

受到自然界早成行为及先天能力的启发,在这项工作中,研究者构建了一个能自然执行给定任务的神经网络。也就是说,找到一个先天的神经网络架构,然后只需要随机初始化的权值就能执行任务。

研究者表示,这种不用学习参数的神经网络架构在强化学习与监督学习都有很好的表现。其实如果想象神经网络架构提供的就是一个圈,那么常规学习权值就是找到一个最优点(或最优参数解)。

但是对于不用学习权重的神经网络,它就相当于引入了一个非常强的归纳偏置,以至于,整个架构偏置到能直接解决某个问题。但是对于不用学习权重的神经网络,它相当于不停地特化架构,或者说降低模型方差。

这样,当架构越来越小而只包含最优解时,随机化的权值也就能解决实际问题了。如研究者那样从小架构到大架构搜索也是可行的,只要架构能正好将最优解包围住就行了。参考资料来源:百度百科-神经网络。

卷积神经网络用全连接层的参数是怎么确定的?

卷积神经网络用全连接层的参数确定:卷积神经网络与传统的人脸检测方法不同,它是通过直接作用于输入样本,用样本来训练网络并最终实现检测任务的A8U神经网络。

它是非参数型的人脸检测方法,可以省去传统方法中建模、参数估计以及参数检验、重建模型等的一系列复杂过程。本文针对图像中任意大小、位置、姿势、方向、肤色、面部表情和光照条件的人脸。

输入层卷积神经网络的输入层可以处理多维数据,常见地,一维卷积神经网络的输入层接收一维或二维数组,其中一维数组通常为时间或频谱采样;二维数组可能包含多个通道;二维卷积神经网络的输入层接收二维或三维数组;三维卷积神经网络的输入层接收四维数组。

由于卷积神经网络在计算机视觉领域应用较广,因此许多研究在介绍其结构时预先假设了三维输入数据,即平面上的二维像素点和RGB通道。

如何选择神经网络的超参数

1、神经网络算法隐含层的选取1.1构造法首先运用三种确定隐含层层数的方法得到三个隐含层层数,找到最小值和最大值,然后从最小值开始逐个验证模型预测误差,直到达到最大值。

最后选取模型误差最小的那个隐含层层数。该方法适用于双隐含层网络。1.2删除法单隐含层网络非线性映射能力较弱,相同问题,为达到预定映射关系,隐层节点要多一些,以增加网络的可调参数,故适合运用删除法。

1.3黄金分割法算法的主要思想:首先在[a,b]内寻找理想的隐含层节点数,这样就充分保证了网络的逼近能力和泛化能力。

为满足高精度逼近的要求,再按照黄金分割原理拓展搜索区间,即得到区间[b,c](其中b=0.619*(c-a)+a),在区间[b,c]中搜索最优,则得到逼近能力更强的隐含层节点数,在实际应用根据要求,从中选取其一即可。

BP神经网络模型各个参数的选取问题

样本变量不需要那么多,因为神经网络的信息存储能力有限,过多的样本会造成一些有用的信息被丢弃。如果样本数量过多,应增加隐层节点数或隐层数目,才能增强学习能力。

一、隐层数一般认为,增加隐层数可以降低网络误差(也有文献认为不一定能有效降低),提高精度,但也使网络复杂化,从而增加了网络的训练时间和出现“过拟合”的倾向。

一般来讲应设计神经网络应优先考虑3层网络(即有1个隐层)。一般地,靠增加隐层节点数来获得较低的误差,其训练效果要比增加隐层数更容易实现。

对于没有隐层的神经网络模型,实际上就是一个线性或非线性(取决于输出层采用线性或非线性转换函数型式)回归模型。

因此,一般认为,应将不含隐层的网络模型归入回归分析中,技术已很成熟,没有必要在神经网络理论中再讨论之。

二、隐层节点数在BP网络中,隐层节点数的选择非常重要,它不仅对建立的神经网络模型的性能影响很大,而且是训练时出现“过拟合”的直接原因,但是目前理论上还没有一种科学的和普遍的确定方法。

目前多数文献中提出的确定隐层节点数的计算公式都是针对训练样本任意多的情况,而且多数是针对最不利的情况,一般工程实践中很难满足,不宜采用。事实上,各种计算公式得到的隐层节点数有时相差几倍甚至上百倍。

为尽可能避免训练时出现“过拟合”现象,保证足够高的网络性能和泛化能力,确定隐层节点数的最基本原则是:在满足精度要求的前提下取尽可能紧凑的结构,即取尽可能少的隐层节点数。

研究表明,隐层节点数不仅与输入/输出层的节点数有关,更与需解决的问题的复杂程度和转换函数的型式以及样本数据的特性等因素有关。

神经网络算法中,参数的设置或者调整,有什么方法可以采用

若果对你有帮助,请点赞。神经网络的结构(例如2输入3隐节点1输出)建好后,一般就要求神经网络里的权值和阈值。

现在一般求解权值和阈值,都是采用梯度下降之类的搜索算法(梯度下降法、牛顿法、列文伯格-马跨特法、狗腿法等等),这些算法会先初始化一个解,在这个解的基础上,确定一个搜索方向和一个移动步长(各种法算确定方向和步长的方法不同,也就使各种算法适用于解决不同的问题),使初始解根据这个方向和步长移动后,能使目标函数的输出(在神经网络中就是预测误差)下降。

然后将它更新为新的解,再继续寻找下一步的移动方向的步长,这样不断的迭代下去,目标函数(神经网络中的预测误差)也不断下降,最终就能找到一个解,使得目标函数(预测误差)比较小。

而在寻解过程中,步长太大,就会搜索得不仔细,可能跨过了优秀的解,而步长太小,又会使寻解过程进行得太慢。因此,步长设置适当非常重要。

学习率对原步长(在梯度下降法中就是梯度的长度)作调整,如果学习率lr=0.1,那么梯度下降法中每次调整的步长就是0.1*梯度,而在matlab神经网络工具箱里的lr,代表的是初始学习率。

因为matlab工具箱为了在寻解不同阶段更智能的选择合适的步长,使用的是可变学习率,它会根据上一次解的调整对目标函数带来的效果来对学习率作调整,再根据学习率决定步长。

机制如下:ifnewE2/E2>maxE_inc%若果误差上升大于阈值lr=lr*lr_dec;%则降低学习率elseifnewE2

祝学习愉快。

神经网络输出神经元个数怎么确定

如果是RBF神经网络,那么只有3层,输入层,隐含层和输出层。确定神经元个数的方法有K-means,ROLS等算法。

现在还没有什么成熟的定理能确定各层神经元的神经元个数和含有几层网络,大多数还是靠经验,不过3层网络可以逼近任意一个非线性网络,神经元个数越多逼近的效果越好。

神经网络可以指向两种,一个是生物神经网络,一个是人工神经网络。生物神经网络:一般指生物的大脑神经元,细胞,触点等组成的网络,用于产生生物的意识,帮助生物进行思考和行动。

人工神经网络(ArtificialNeuralNetworks,简写为ANNs)也简称为神经网络(NNs)或称作连接模型(ConnectionModel),它是一种模仿动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。

这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。人工神经网络:是一种应用类似于大脑神经突触联接的结构进行信息处理的数学模型。

在工程与学术界也常直接简称为“神经网络”或类神经网络。

神经网络输出神经元个数如何确定

输出神经元个数是按你的需要确定的,比如你需要模拟函数y=1/x,那么你的输入向量就是x,输出就是y=1/x,也就是一个输出。再比如你需要模拟水体中的cod,bod参数值,那么你的输出就是两个。

你的情况,比如说,你做符号识别的目的是将符号区分为正常符号和异常符号,那么你的输出就是2个,是由实际需要来的。

神经网络weight参数怎么初始化

不一定,也可设置为[-1,1]之间。事实上,必须要有权值为负数,不然只有激活神经元,没有抑制的也不行。至于为什么在[-1,1]之间就足够了,这是因为归一化和Sigmoid函数输出区间限制这两个原因。

一般在编程时,设置一个矩阵为bounds=ones(S,1)*[-1,1];%权值上下界。在MATLAB中,可以直接使用net=init(net);来初始化。

我们可以通过设定网络参数net.initFcn和net.layer{i}.initFcn这一技巧来初始化一个给定的网络。net.initFcn用来决定整个网络的初始化函数。

前馈网络的缺省值为initlay,它允许每一层用单独的初始化函数。设定了net.initFcn,那么参数net.layer{i}.initFcn也要设定用来决定每一层的初始化函数。

对前馈网络来说,有两种不同的初始化方式经常被用到:initwb和initnw。

initwb函数根据每一层自己的初始化参数(net.inputWeights{i,j}.initFcn)初始化权重矩阵和偏置。前馈网络的初始化权重通常设为rands,它使权重在-1到1之间随机取值。

这种方式经常用在转换函数是线性函数时。initnw通常用于转换函数是曲线函数。

它根据Nguyen和Widrow[NgWi90]为层产生初始权重和偏置值,使得每层神经元的活动区域能大致平坦的分布在输入空间。

通过哪些参数看神经网络拟合出来的函数效果?神经网络拟合时如何确定隐藏的节点数? 10

主要看均方误差和其百分比(准确率)。假如你拟合出来是ui,计算(yi-ui)^2的平均值,然后计算这个平均值与yi平均值的比(也就是均方误差百分比),当然用1减去这个百分比就是准确率了。

一般也会画一幅图,把yi和ui分别用不同的颜色或者符号表示出来,直观对比。拟合时的隐含层节点数目前没有一个通行的公式进行确定,只能凭借经验和试凑。

一般情况下,问题的复杂程度(非线性程度和维度)越高,隐含层节点数越多。这里介绍一个小经验:先用不太大的节点数进行预测,如果增加节点数测试集准确率和训练集准确率都有所提升,则应该继续增加。

如果增加节点数测试集准确率增加很不明显,而训练集准确率还是有所提升,则不应该继续增加,当前的就是很理想的,继续增加节点数只会起到反效果。

SPSS的神经网络模型参数设置疑问

边栏推荐

猜你喜欢

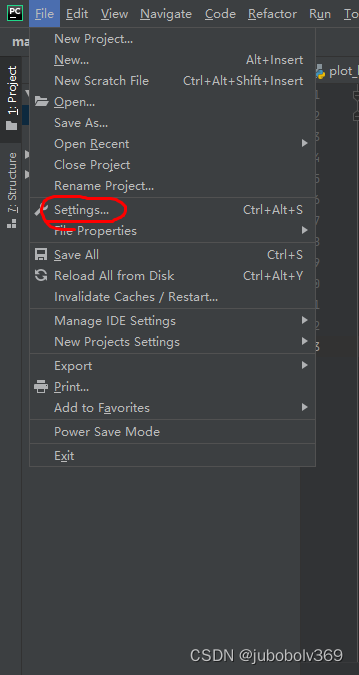

pycharm中绘图,显示不了figure窗口的问题

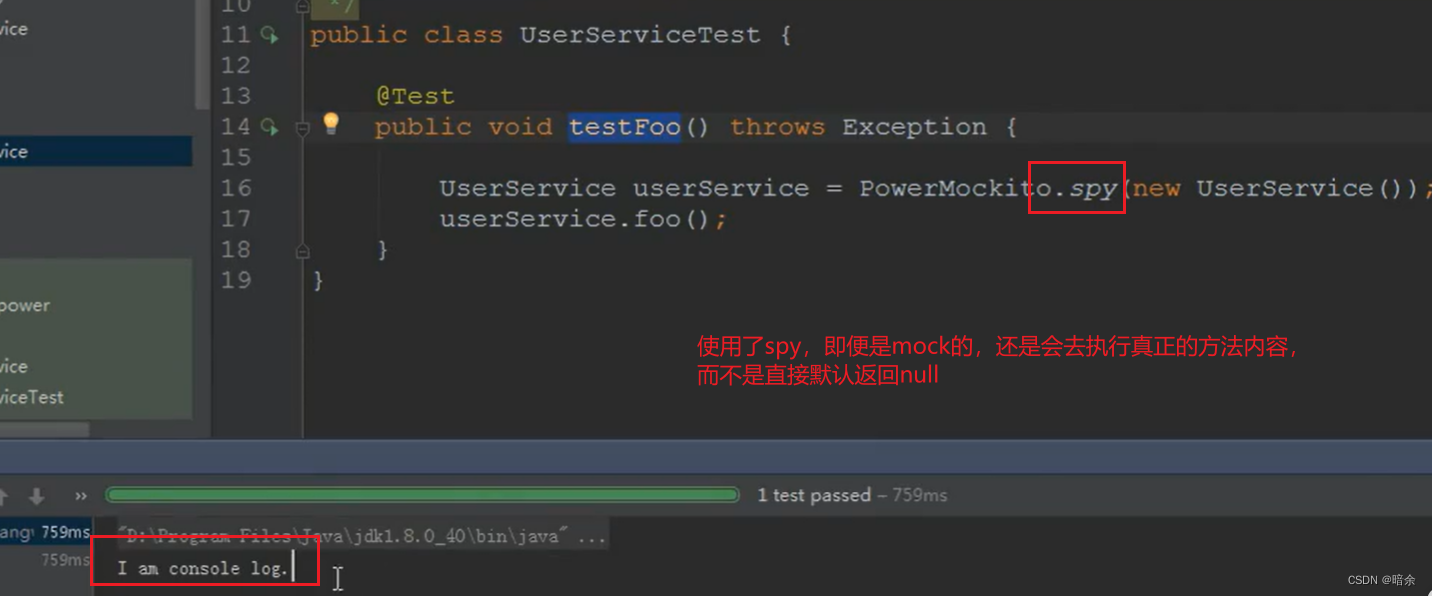

单元测试系统化讲解之PowerMock

软件定制开发——企业定制开发app软件的优势

IPQ4019/IPQ4029 support WiFi6 MiniPCIe Module 2T2R 2×2.4GHz 2x5GHz MT7915 MT7975

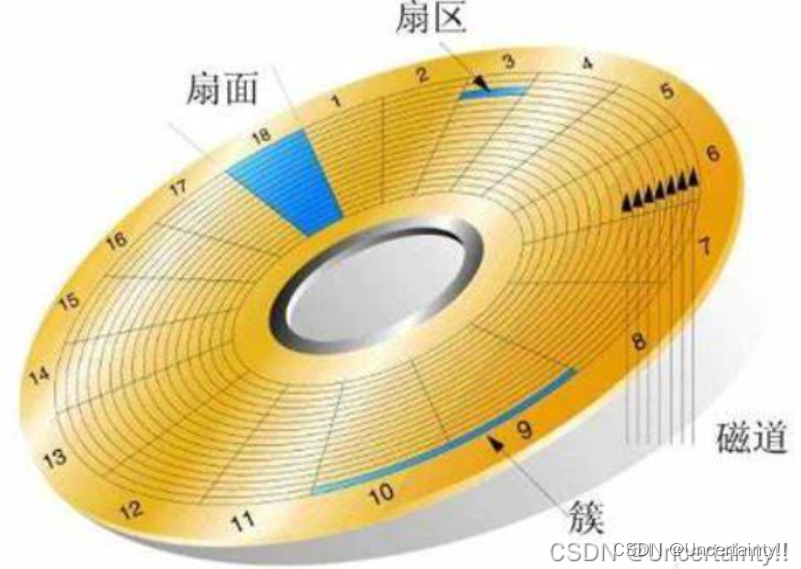

磁盘管理:磁盘结构

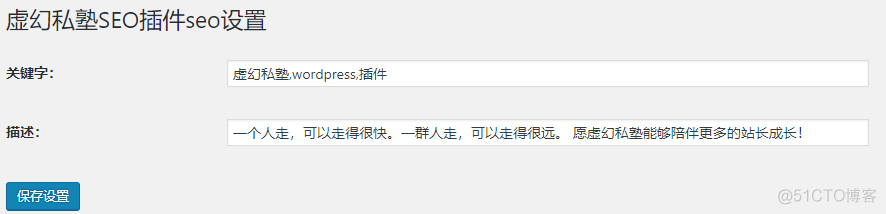

wordpress插件开发03-简单的all in one seo 插件开发

Audio and video + AI, Zhongguancun Kejin helps a bank explore a new development path | Case study

![[wxGlade learning] wxGlade environment configuration](/img/fd/32ceb707c4468e18038b813b6f3925.png)

[wxGlade learning] wxGlade environment configuration

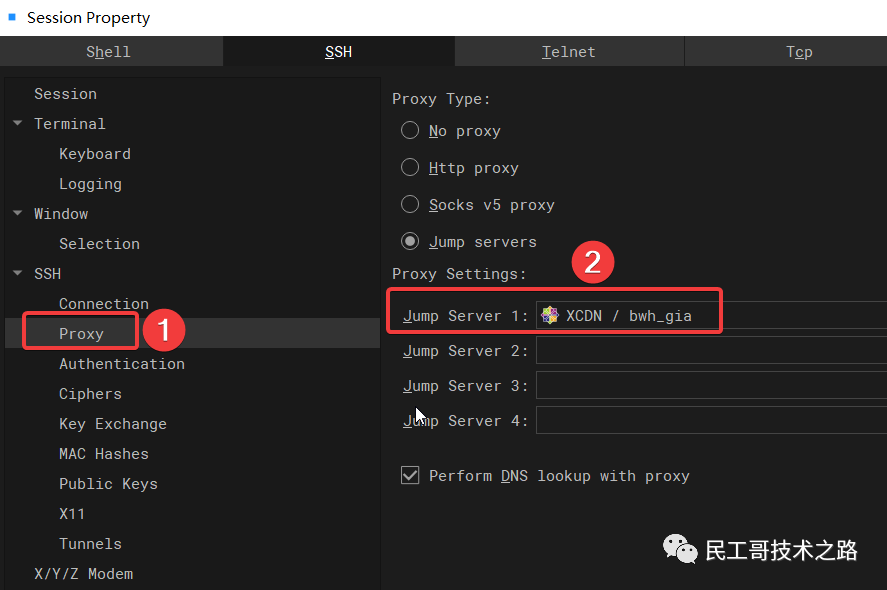

新一代开源免费的轻量级 SSH 终端,非常炫酷好用!

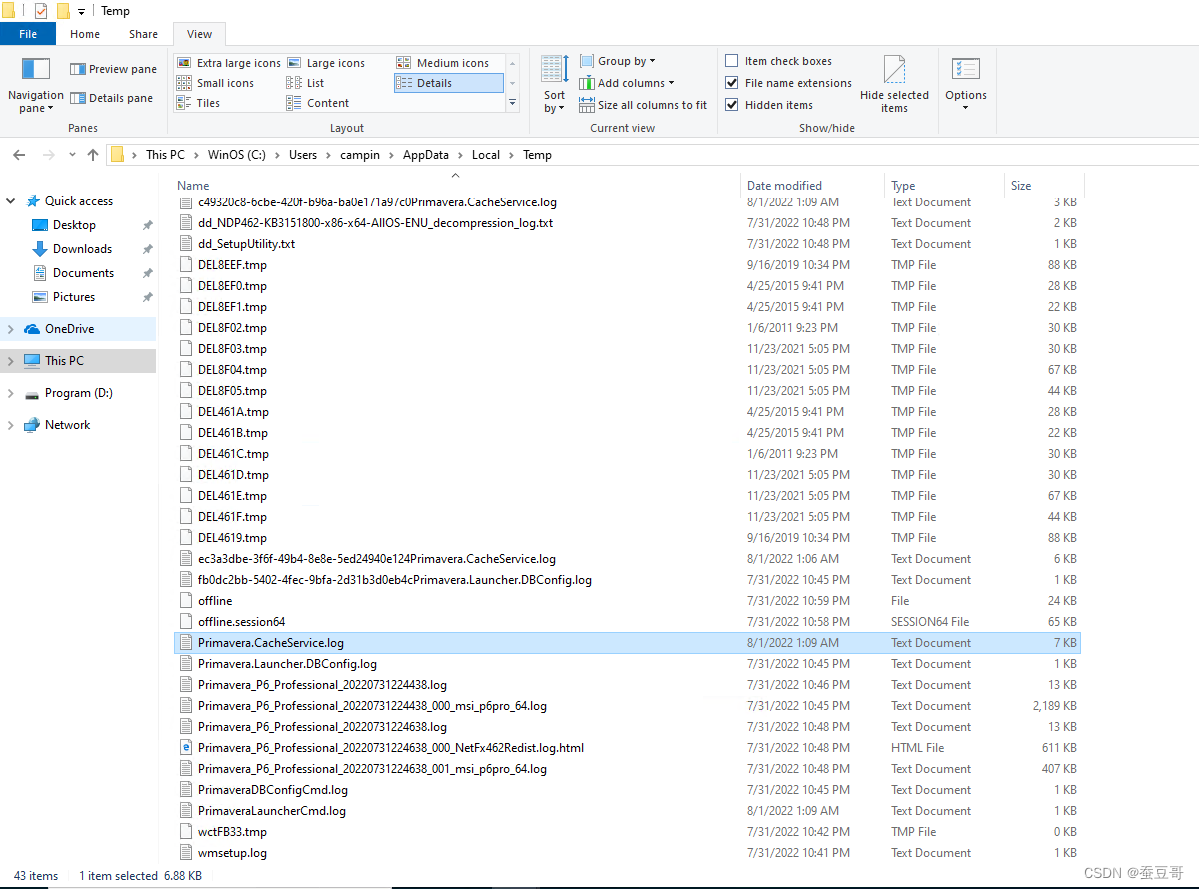

Primavera P6 Professional 21.12 登录异常案例分享

随机推荐

canvas图片操作

企业展厅制作要具备的六大功能

2022-08-09 顾宇佳 学习笔记

ES6:数值的扩展

单元测试系统化讲解之PowerMock

mysql中查询多个表中的数据量

1002 A+B for Polynomials

Typescript基本类型---下篇

【剑指offer】左旋字符串,替换空格,还有类题!!!

MongoDB 对索引的创建查询修改删除 附代码

如何在移动钱包中搭建一个小程序应用商店

Halcon算子解释

【系统梳理】微服务的注册和发现中心

Rust从入门到精通06-函数

mindspore中MindDataset读取mindrecord文件问题

刷题错题录2-向上取整、三角形条件、字符串拼接匹配、三数排序思路

阿里云OSS上传文件超时 探测工具排查方法

[wxGlade learning] wxGlade environment configuration

Quickly submit a PR (Web) for OpenHarmony in 5 minutes

YTU 2297: KMP模式匹配 三(串)