当前位置:网站首页>自定义训练,使用Generator dataset迭代数据报错

自定义训练,使用Generator dataset迭代数据报错

2022-08-10 03:28:00 【小乐快乐】

mindspore 1.3 Ascend 910环境

因为任务要求,我没有使用高层的model.train()接口,而是自定义训练过程,像pytorch那样训练,使用Generator Dataset迭代数据,第一个epoch数据正常迭代,下一个epoch就会报错。在每个epoch迭代之后,我都对dataset进行了reset,是不是我reset的位置不对或是少了什么东西?

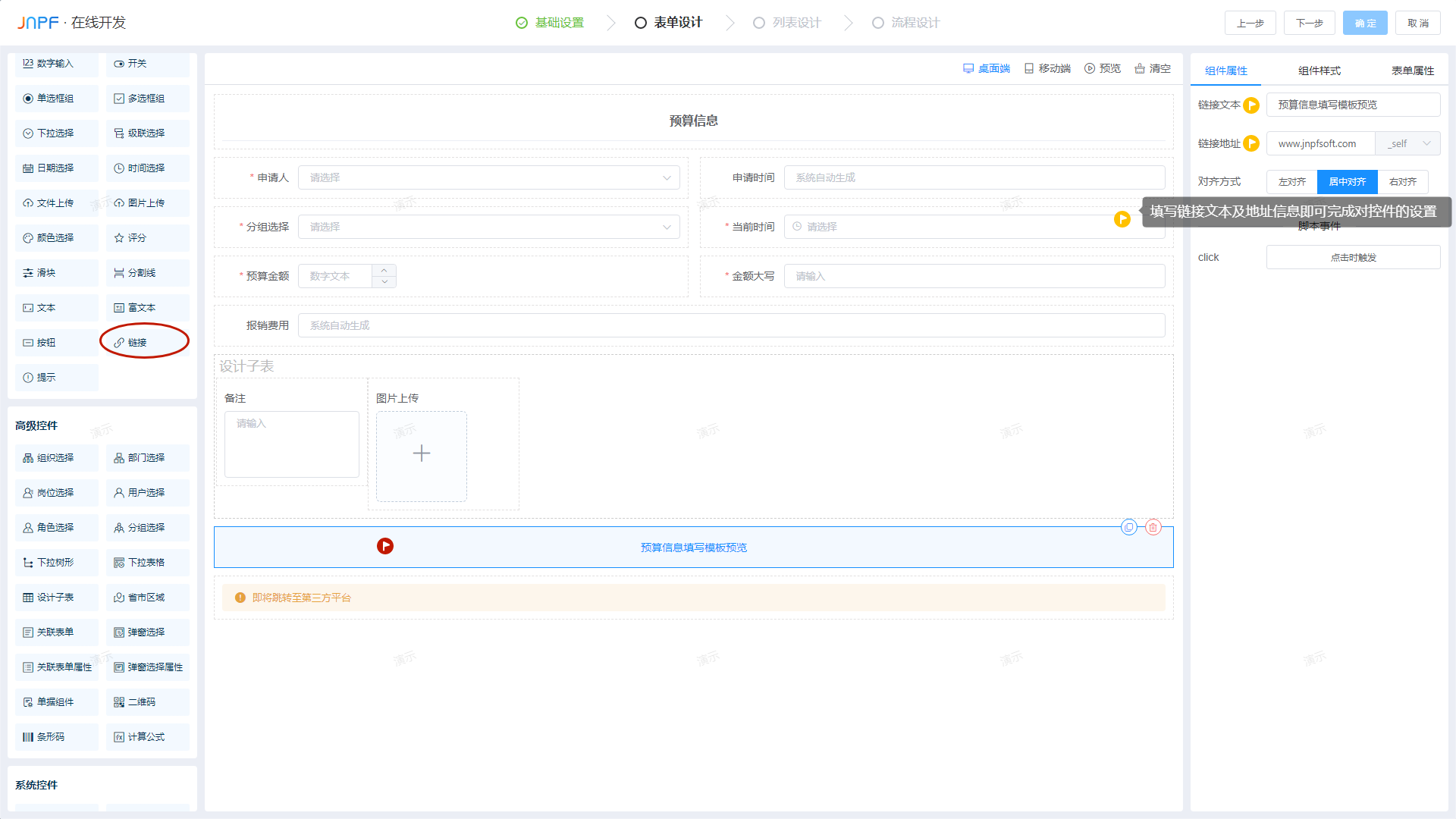

报错的截图:

根据报错的信息,你自定义的dataset 的 __len__ 函数返回值是 36,但是真实的 __next__ 返回的数据量只有35 条,这个校验错误,所以报错了。

快速验证的话,你可以把 __len__的返回值改成 35 再试下。

边栏推荐

- 如何将 @Transactional 事务注解运用到炉火纯青?

- 数据库学习真难,头大,有偿提问

- Take you to an in-depth understanding of the version update of 3.4.2, what does it bring to users?

- Kotlin协程:父子协程的绑定与传递

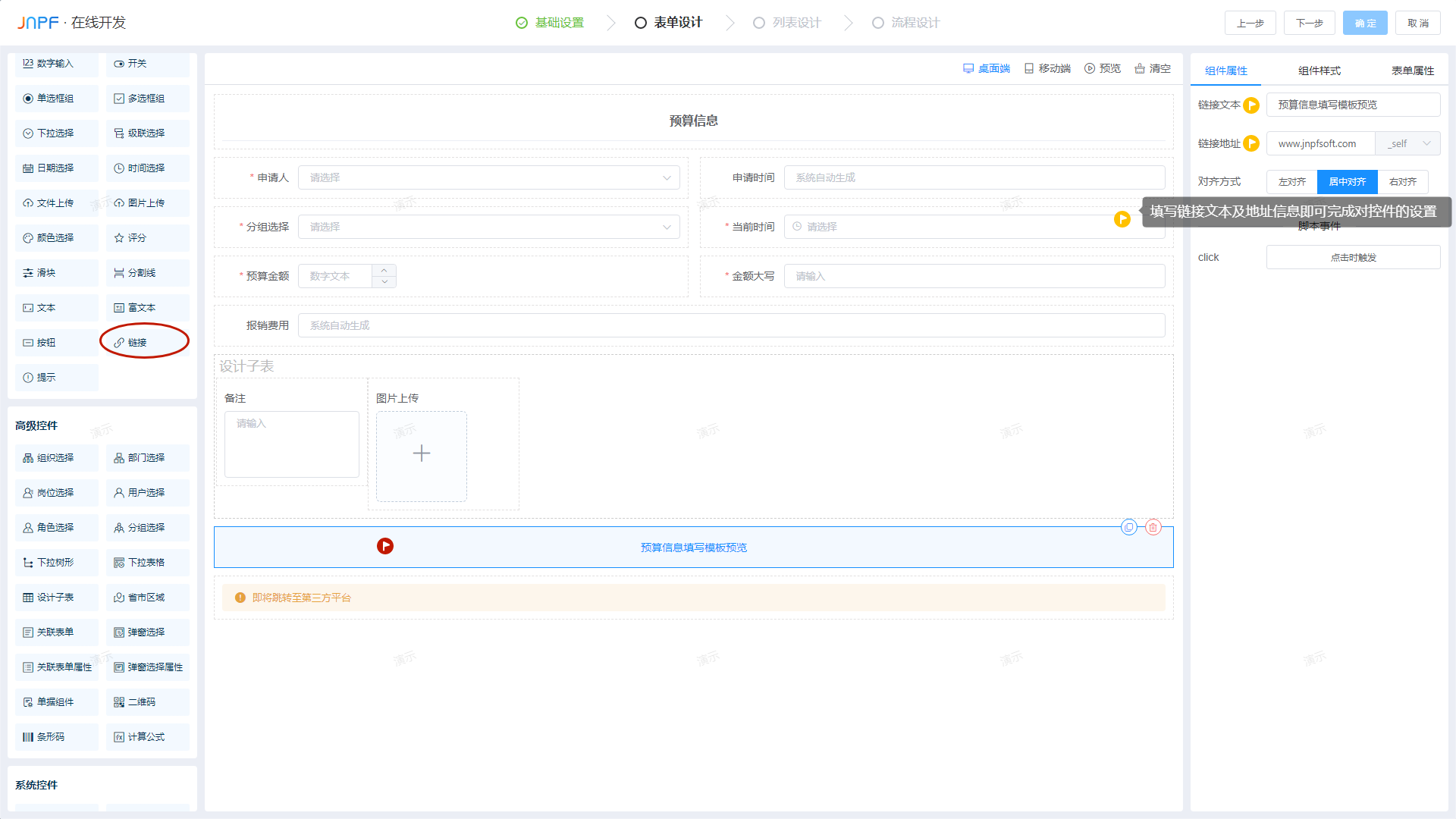

- 从零开始配置 vim(9)——初始配置

- Did not detect default resource location for test class xxxx

- 请教各位confluence部署连接数据库成功,但是在后面建表设置的时候报错

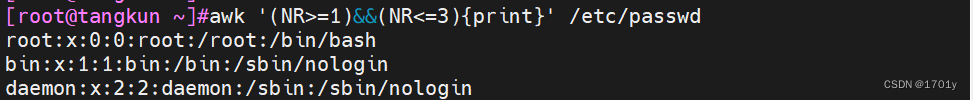

- Shell 文本三剑客 awk

- charles的功能操作

- MySQL数据库初体验

猜你喜欢

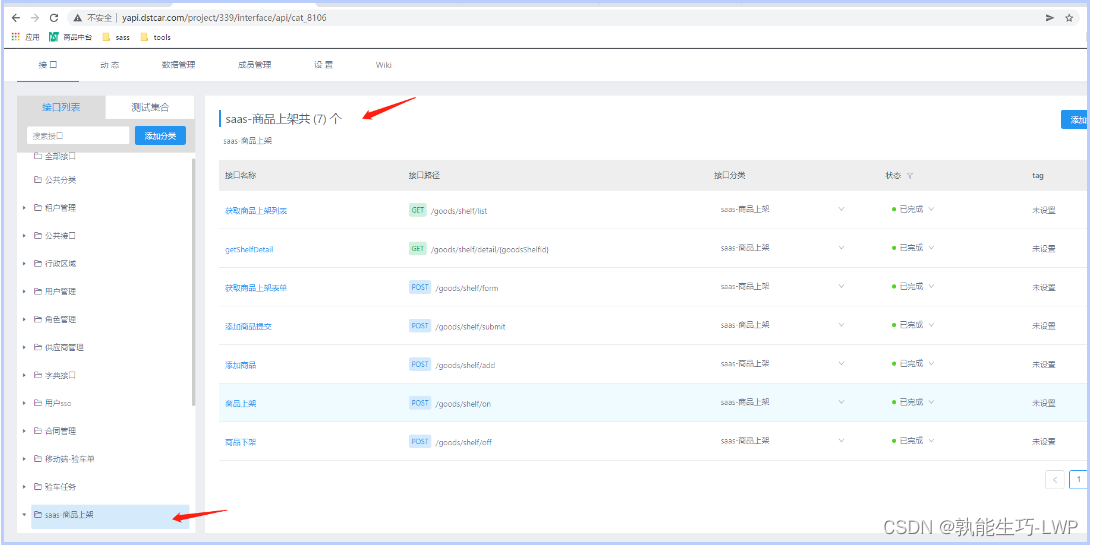

带你深入理解3.4.2的版本更新,对用户带来了什么?

Take you to an in-depth understanding of the version update of 3.4.2, what does it bring to users?

从零开始配置 vim(9)——初始配置

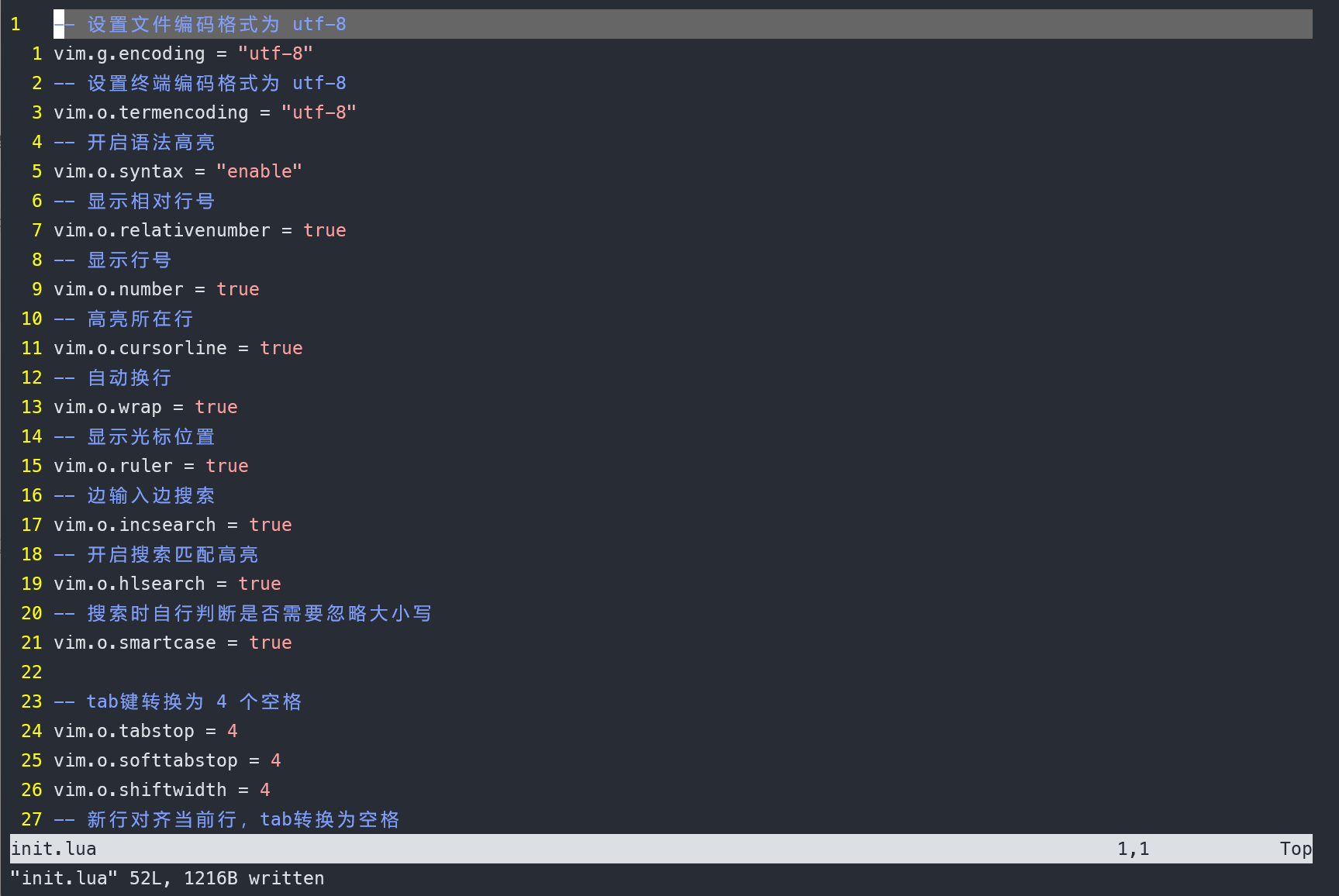

YAPI使用

中国人保为德科康材承保产品责任险,为消费者权益保驾护航!

Do you know these basic types of software testing?

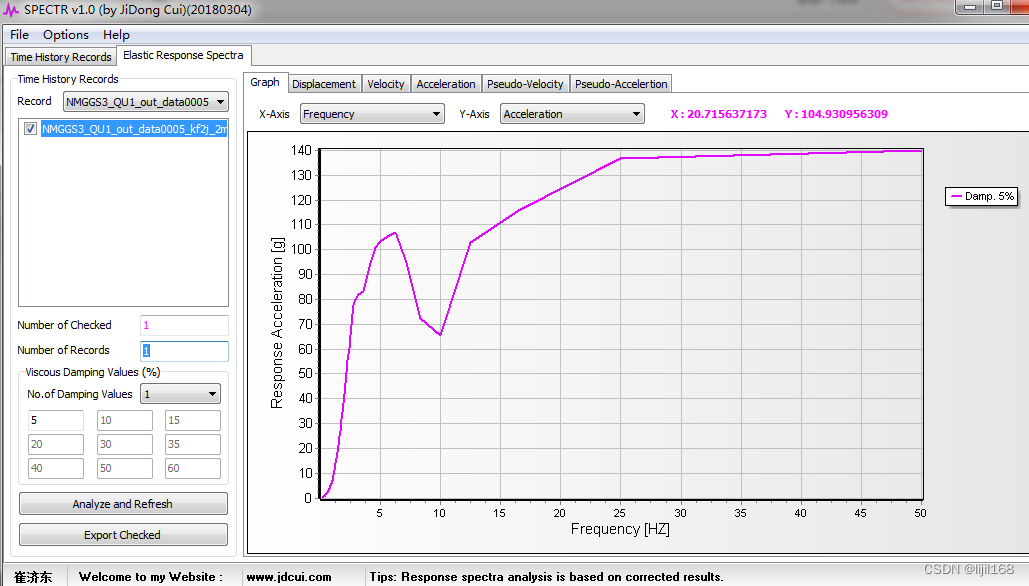

matlab simulink响应谱计算

shell文本编辑awk

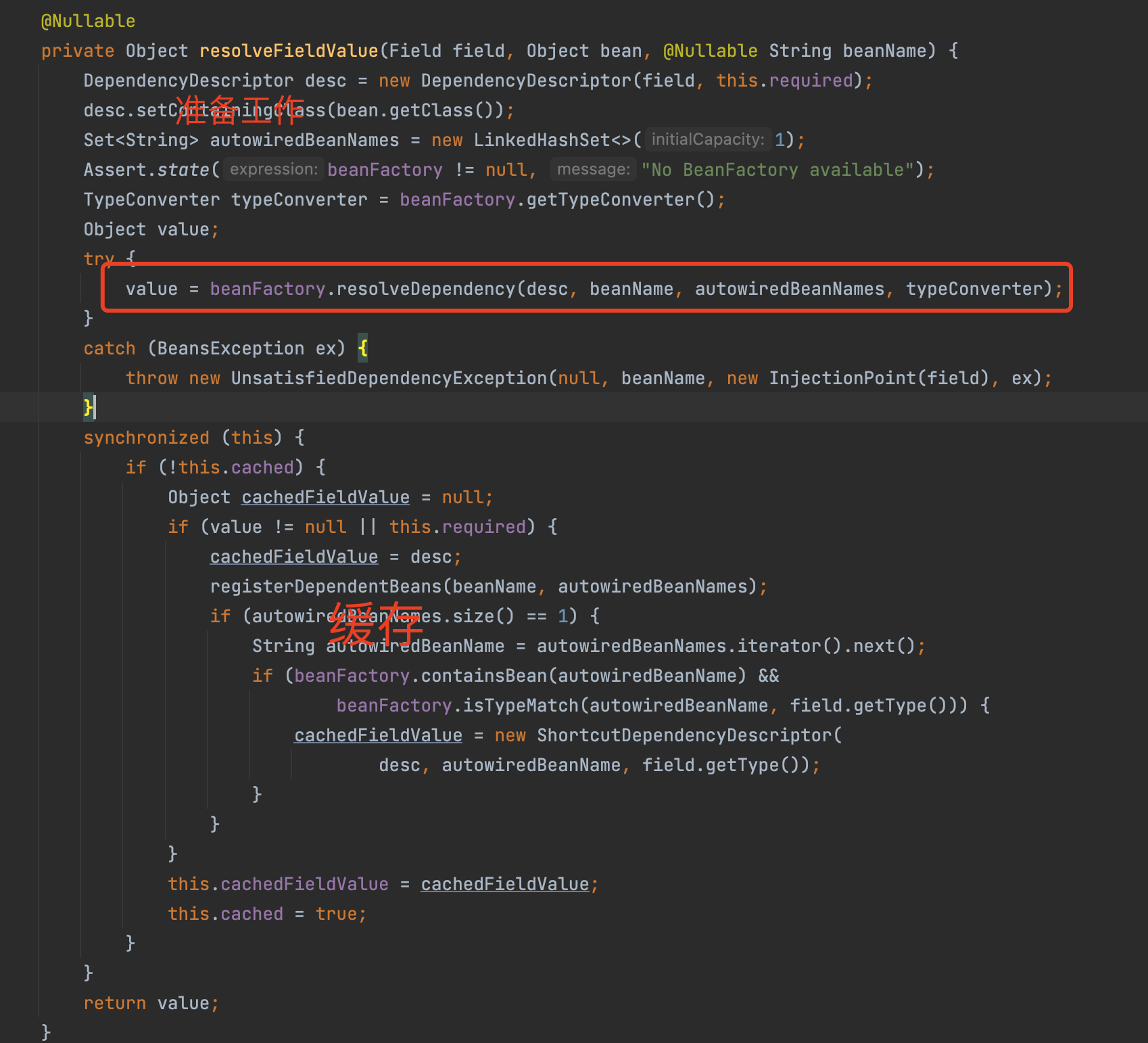

@Autowired注解 --required a single bean, but 2 were found出现的原因以及解决方法

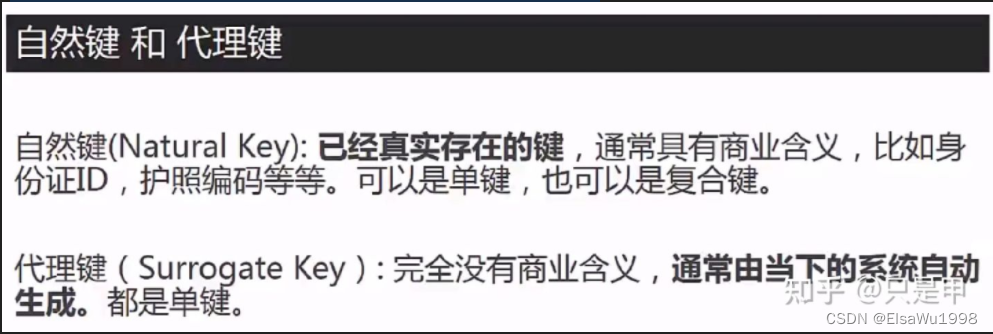

维度表设计

随机推荐

同样是初级测试,凭什么他比我薪资高 5000 块?

@Autowired注解 --required a single bean, but 2 were found出现的原因以及解决方法

【IO复用】poll

UDP协议之《套接口阻塞选项UDP_CORK》

C语言顺序表(源码)

软件的生命周期(软件工程各阶段的工作)

数据仓库建模实践

清洁环保的小型风电滑环基本介绍

Pen paper records

TCP协议之《数据与控制流程交叉时的延迟处理》

【Verilog数字系统设计(夏雨闻)6-------模块的结构、数据类型、变量和基本运算符号2】

ARP欺骗-教程详解

leetcode 283:移动零

如何整合全流程数据,全面提升研发效能?|2分钟了解 ONES

小程序分包及分包预下载

请教各位confluence部署连接数据库成功,但是在后面建表设置的时候报错

applet wxs

使用 requestAnimationFrame 提升 web 性能

Mini Program Navigation and Navigation Parameters

matlab simulink响应谱计算