当前位置:网站首页>pyspark列合并为一行

pyspark列合并为一行

2022-08-10 17:50:00 【51CTO】

将 dataframe 利用 pyspark 列合并为一行,类似于 sql 的 GROUP_CONCAT 函数。例如如下 dataframe :

需要按照列相同的列 d 将 s 合并,想要的结果为:

利用 groupby 去实现就好,spark 里面可以用 concat_ws 实现,可以看这个 Spark中SQL列合并为一行,而这里的 concat_ws 合并缺很奇怪, 官方文档的实例为:

作者自己尝试得到:

不是想要的效果。而 collect_list 能得到相同的效果:

得到的结果为:

如果需要collect_list多列,那么可以这么写:

得到的结果为:

边栏推荐

猜你喜欢

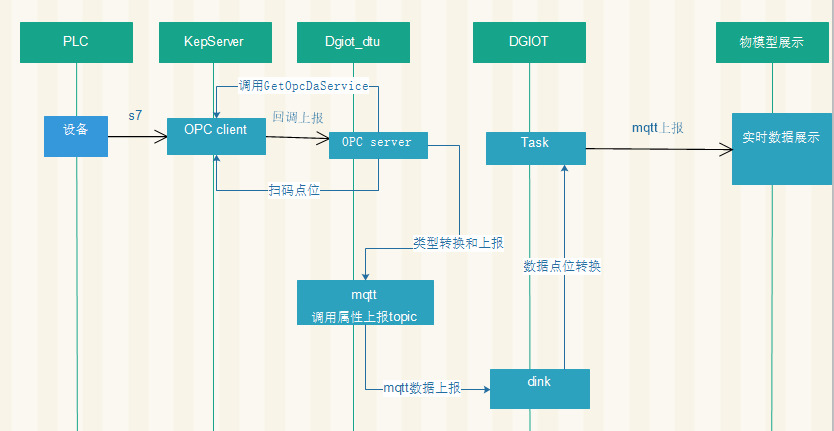

The DGIOT platform displays the whole process code analysis of OPC reporting data in real time

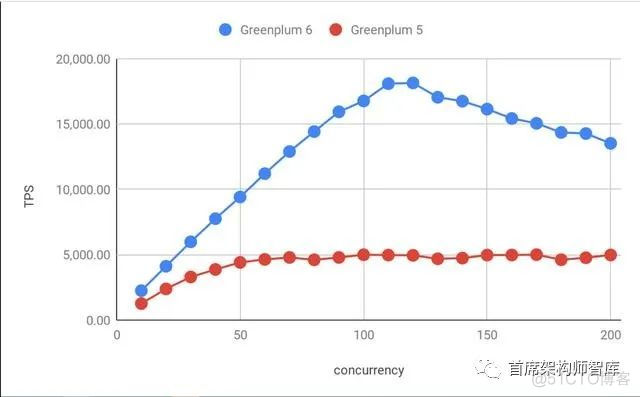

「NewSQL技术」Greenplum 6中的OLTP负载性能提升60倍以上

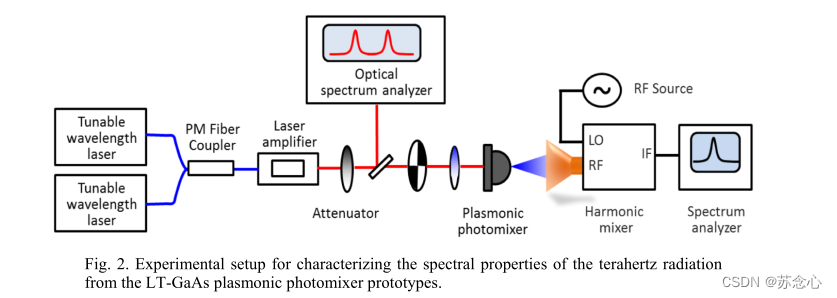

【2015】【论文笔记】等离子光混合器THz辐射的光谱——

老板加薪!看我做的WPF Loading!!!

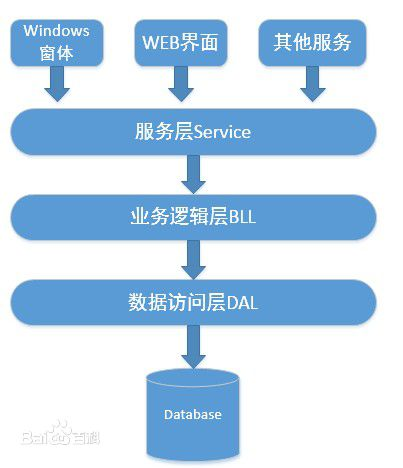

架构-三层架构:三层架构

中国芯片的营收首破万亿,优势凸显的成熟工艺产能将称霸全球

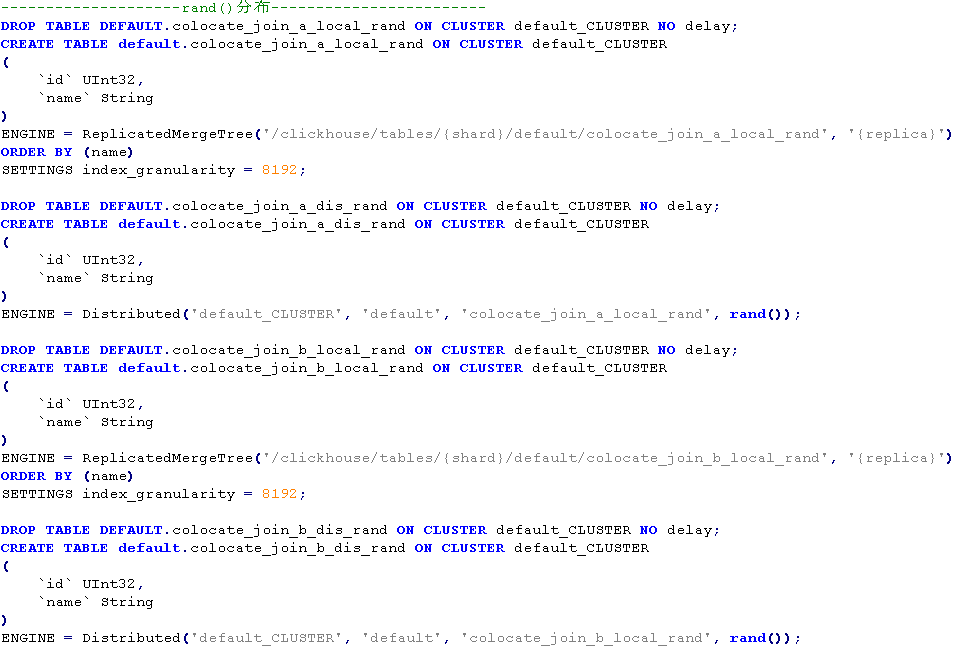

Colocate Join :ClickHouse的一种高性能分布式join查询模型

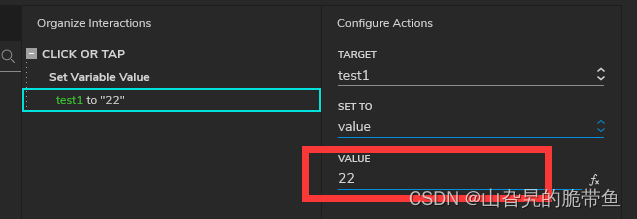

产品-Axure9英文版,A页面内a1状态跳转B页面的b2状态,(条件跳转状态)

Toronto Research Chemicals BTK抑制剂丨ACP-5197

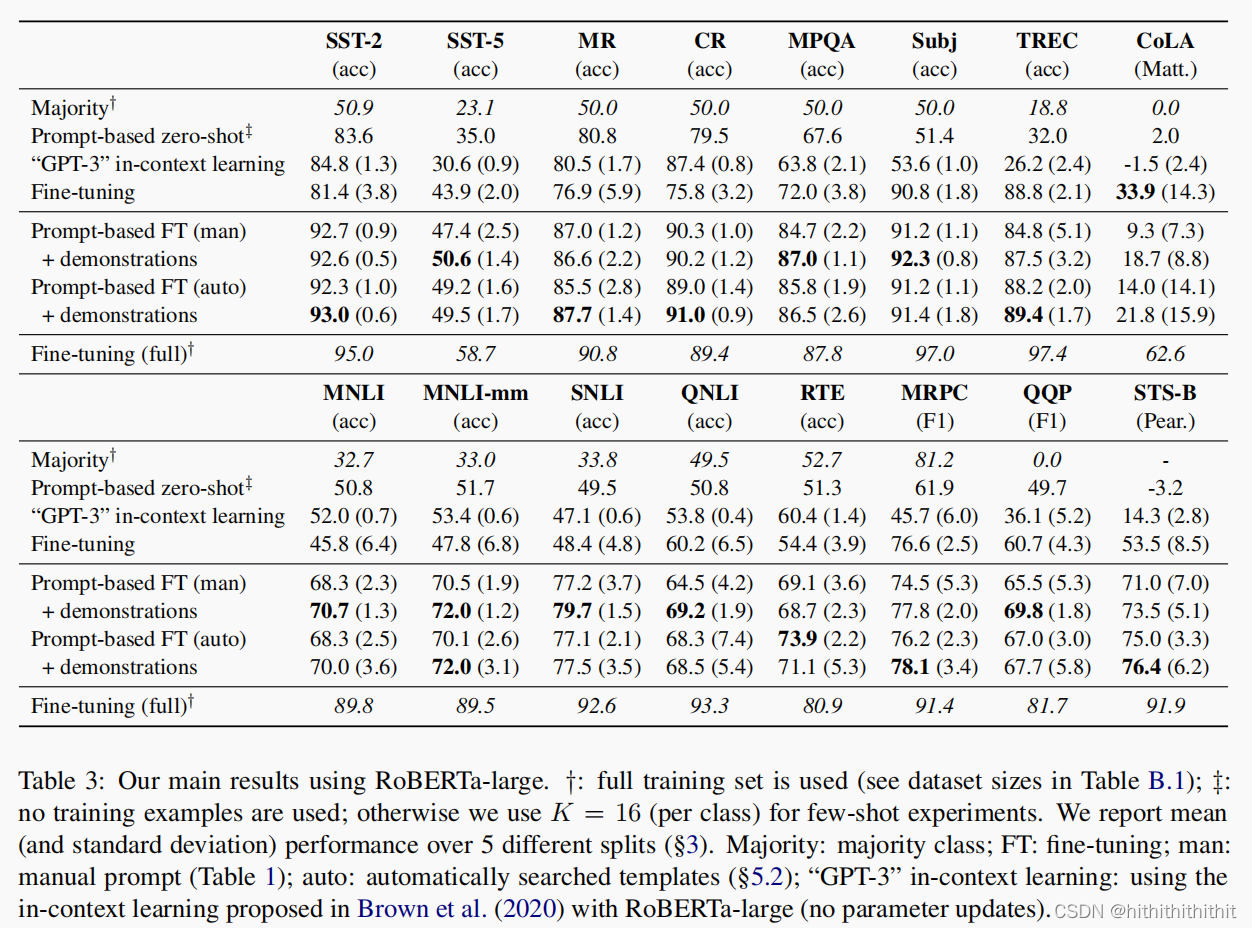

Making Pre-trained Language Models Better Few-Shot Learners

随机推荐

R语言拟合ARIMA模型:使用forecast包中的auto.arima函数自动搜索最佳参数组合、模型阶数(p,d,q)、如果已知阶数则直接使用arima函数构建模型(order参数指定阶数)

Toronto Research Chemicals 对乙酰氧基苯乙酮说明书

多线程与高并发(11)——经典面试题之实现一个容器,提供两个方法,add,size。

MongoDB教程

const的自己理解

【图像分割】基于元胞自动机实现图像分割附matlab代码

股票量化交易策略:多因子筛选练习

hping3的使用

文档标题能否支持公式

五菱宏光MINI EV,唯一的缺点就是安全性

JNDI and RMI, LDAP

机器人控制器编程实践指导书旧版-实践七 无线通信(网络)

R语言使用ggpubr包的ggbarplot函数可视化柱状图、设置add参数为mean_se和jitter可视化不同水平均值的柱状图并为柱状图添加误差线(se标准误差)和抖动数据点分布

ZLMediaKit 服务器源码解读---RTSP推流拉流

本周四晚19:00知识赋能第六期第5课丨OpenHarmony WiFi子系统

关于奉加微PHY62xx系列如何选型?PHY6222/PHY6212/PHY6252

Return the next higher prime number

【2011】【论文笔记】用THz-TDS观察水树——

WebRTC source code analysis nack detailed explanation

Toronto Research Chemicals BTK抑制剂丨ACP-5197