当前位置:网站首页>分类常用的神经网络模型,深度神经网络主要模型

分类常用的神经网络模型,深度神经网络主要模型

2022-08-10 16:34:00 【阳阳2013哈哈】

请简述一下神经网络的PDB模型 5

。

资料1.人工神经网络理论基础包括:(1)PDP(ParallelDistribatedProcessing)模式(2)容限理论(3)网络拓扑(4)混沌理论1、PDP模式PDP模式是一种认知心理的平行分布式模式。

认知是信息处理过程,并且是知觉、注意、记忆、学习、表象、思维、概念形式、问题求解、语言、情绪、个性差异等等有机联系的处理过程。PDP模式是一种接近人类思维推论的模式。

人脑中知识的表达是采用分布式的表达结构,人脑的控制是实行分布式的控制方式。相互作用、相互限制是PDP模式的基本思想,平行分布是PDP模式的基本构架。

PDP模式的实施,需要一种合理的表示方法,其中一种表示方法便是人工神经网络表示法。即采用类似于大脑神经网络的体系结构,在这种基本体系结构下,使人工神经网络经过学习训练,能适应多种知识体系。

参考:?boardid=7&id=924&star=1&page=2资料2.神经网络模型信息加工模型有助于理论家把其理论假设进一步细致化、具体化。

然而正如我们在第一节所讨论过的,遵循联结主义传统的学者对比提出了反对意见,认为这一模型假设认知过程是继时性流动,而事实并非总是如此,(参见Rumelhart,Hinton,和McClelland,1986),至少有一些认知过程更可能是同时发生的。

比如说司机开车时可同时与人讲话。一种用得越来越多的模型是神经网络模型(或称并行分布模型)。这类模型认为不同的认知过程可以同时发生,这一假设与人们的主观感觉相一致:许多东西同时出现在脑海中。

这一假设还与我们已知的大脑神经的操作相一致。神经网络模型假设有一系列相互连接的加工单元,而且这些单元的激活水平是不同的。根据不同的传播规则,激活从一个单元传播到与之相连的其它单元。参考:3.。

人工神经网络有哪些类型

人工神经网络模型主要考虑网络连接的拓扑结构、神经元的特征、学习规则等常见的神经网络结构。目前,已有近40种神经网络模型,其中有反传网络、感知器、自组织映射、Hopfield网络、波耳兹曼机、适应谐振理论等。

根据连接的拓扑结构,神经网络模型可以分为:(1)前向网络网络中各个神经元接受前一级的输入,并输出到下一级,网络中没有反馈,可以用一个有向无环路图表示。

这种网络实现信号从输入空间到输出空间的变换,它的信息处理能力来自于简单非线性函数的多次复合。网络结构简单,易于实现。反传网络是一种典型的前向网络。

(2)反馈网络网络内神经元间有反馈,可以用一个无向的完备图表示。这种神经网络的信息处理是状态的变换,可以用动力学系统理论处理。系统的稳定性与联想记忆功能有密切关系。

Hopfield网络、波耳兹曼机均属于这种类型。学习是神经网络研究的一个重要内容,它的适应性是通过学习实现的。根据环境的变化,对权值进行调整,改善系统的行为。

由Hebb提出的Hebb学习规则为神经网络的学习算法奠定了基础。Hebb规则认为学习过程最终发生在神经元之间的突触部位,突触的联系强度随着突触前后神经元的活动而变化。

在此基础上,人们提出了各种学习规则和算法,以适应不同网络模型的需要。

有效的学习算法,使得神经网络能够通过连接权值的调整,构造客观世界的内在表示,形成具有特色的信息处理方法,信息存储和处理体现在网络的连接中。

根据学习环境不同,神经网络的学习方式可分为监督学习和非监督学习。

在监督学习中,将训练样本的数据加到网络输入端,同时将相应的期望输出与网络输出相比较,得到误差信号,以此控制权值连接强度的调整,经多次训练后收敛到一个确定的权值。

当样本情况发生变化时,经学习可以修改权值以适应新的环境。使用监督学习的神经网络模型有反传网络、感知器等。非监督学习时,事先不给定标准样本,直接将网络置于环境之中,学习阶段与工作阶段成为一体。

此时,学习规律的变化服从连接权值的演变方程。非监督学习最简单的例子是Hebb学习规则。竞争学习规则是一个更复杂的非监督学习的例子,它是根据已建立的聚类进行权值调整。

自组织映射、适应谐振理论网络等都是与竞争学习有关的典型模型。

研究神经网络的非线性动力学性质,主要采用动力学系统理论、非线性规划理论和统计理论,来分析神经网络的演化过程和吸引子的性质,探索神经网络的协同行为和集体计算功能,了解神经信息处理机制。

为了探讨神经网络在整体性和模糊性方面处理信息的可能,混沌理论的概念和方法将会发挥作用。混沌是一个相当难以精确定义的数学概念。

一般而言,“混沌”是指由确定性方程描述的动力学系统中表现出的非确定性行为,或称之为确定的随机性。

“确定性”是因为它由内在的原因而不是外来的噪声或干扰所产生,而“随机性”是指其不规则的、不能预测的行为,只可能用统计的方法描述。

混沌动力学系统的主要特征是其状态对初始条件的灵敏依赖性,混沌反映其内在的随机性。

混沌理论是指描述具有混沌行为的非线性动力学系统的基本理论、概念、方法,它把动力学系统的复杂行为理解为其自身与其在同外界进行物质、能量和信息交换过程中内在的有结构的行为,而不是外来的和偶然的行为,混沌状态是一种定态。

混沌动力学系统的定态包括:静止、平稳量、周期性、准同期性和混沌解。混沌轨线是整体上稳定与局部不稳定相结合的结果,称之为奇异吸引子。

有人可以介绍一下什么是"神经网络"吗?

由于神经网络是多学科交叉的产物,各个相关的学科领域对神经网络都有各自的看法,因此,关于神经网络的定义,在科学界存在许多不同的见解。

目前使用得最广泛的是T.Koholen的定义,即"神经网络是由具有适应性的简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应。

"如果我们将人脑神经信息活动的特点与现行冯·诺依曼计算机的工作方式进行比较,就可以看出人脑具有以下鲜明特征:1.巨量并行性。

在冯·诺依曼机中,信息处理的方式是集中、串行的,即所有的程序指令都必须调到CPU中后再一条一条地执行。而人在识别一幅图像或作出一项决策时,存在于脑中的多方面的知识和经验会同时并发作用以迅速作出解答。

据研究,人脑中约有多达10^(10)~10^(11)数量级的神经元,每一个神经元具有103数量级的连接,这就提供了巨大的存储容量,在需要时能以很高的反应速度作出判断。

2.信息处理和存储单元结合在一起。在冯·诺依曼机中,存储内容和存储地址是分开的,必须先找出存储器的地址,然后才能查出所存储的内容。一旦存储器发生了硬件故障,存储器中存储的所有信息就都将受到毁坏。

而人脑神经元既有信息处理能力又有存储功能,所以它在进行回忆时不仅不用先找存储地址再调出所存内容,而且可以由一部分内容恢复全部内容。

当发生"硬件"故障(例如头部受伤)时,并不是所有存储的信息都失效,而是仅有被损坏得最严重的那部分信息丢失。3.自组织自学习功能。

冯·诺依曼机没有主动学习能力和自适应能力,它只能不折不扣地按照人们已经编制好的程序步骤来进行相应的数值计算或逻辑计算。

而人脑能够通过内部自组织、自学习的能力,不断地适应外界环境,从而可以有效地处理各种模拟的、模糊的或随机的问题。神经网络研究的主要发展过程大致可分为四个阶段:1.第一阶段是在五十年代中期之前。

西班牙解剖学家Cajal于十九世纪末创立了神经元学说,该学说认为神经元的形状呈两极,其细胞体和树突从其他神经元接受冲动,而轴索则将信号向远离细胞体的方向传递。

在他之后发明的各种染色技术和微电极技术不断提供了有关神经元的主要特征及其电学性质。

1943年,美国的心理学家W.S.McCulloch和数学家W.A.Pitts在论文《神经活动中所蕴含思想的逻辑活动》中,提出了一个非常简单的神经元模型,即M-P模型。

该模型将神经元当作一个功能逻辑器件来对待,从而开创了神经网络模型的理论研究。

1949年,心理学家D.O.Hebb写了一本题为《行为的组织》的书,在这本书中他提出了神经元之间连接强度变化的规则,即后来所谓的Hebb学习法则。

Hebb写道:"当神经细胞A的轴突足够靠近细胞B并能使之兴奋时,如果A重复或持续地激发B,那么这两个细胞或其中一个细胞上必然有某种生长或代谢过程上的变化,这种变化使A激活B的效率有所增加。

"简单地说,就是如果两个神经元都处于兴奋状态,那么它们之间的突触连接强度将会得到增强。

五十年代初,生理学家Hodykin和数学家Huxley在研究神经细胞膜等效电路时,将膜上离子的迁移变化分别等效为可变的Na+电阻和K+电阻,从而建立了著名的Hodykin-Huxley方程。

这些先驱者的工作激发了许多学者从事这一领域的研究,从而为神经计算的出现打下了基础。2.第二阶段从五十年代中期到六十年代末。

1958年,F.Rosenblatt等人研制出了历史上第一个具有学习型神经网络特点的模式识别装置,即代号为MarkI的感知机(Perceptron),这一重大事件是神经网络研究进入第二阶段的标志。

对于最简单的没有中间层的感知机,Rosenblatt证明了一种学习算法的收敛性,这种学习算法通过迭代地改变连接权来使网络执行预期的计算。

稍后于Rosenblatt,B.Widrow等人创造出了一种不同类型的会学习的神经网络处理单元,即自适应线性元件Adaline,并且还为Adaline找出了一种有力的学习规则,这个规则至今仍被广泛应用。

Widrow还建立了第一家神经计算机硬件公司,并在六十年代中期实际生产商用神经计算机和神经计算机软件。

除Rosenblatt和Widrow外,在这个阶段还有许多人在神经计算的结构和实现思想方面作出了很大的贡献。例如,K.Steinbuch研究了称为学习矩阵的一种二进制联想网络结构及其硬件实现。

N.Nilsson于1965年出版的《机器学习》一书对这一时期的活动作了总结。3.第三阶段从六十年代末到八十年代初。

第三阶段开始的标志是1969年M.Minsky和S.Papert所著的《感知机》一书的出版。

该书对单层神经网络进行了深入分析,并且从数学上证明了这种网络功能有限,甚至不能解决象"异或"这样的简单逻辑运算问题。同时,他们还发现有许多模式是不能用单层网络训练的,而多层网络是否可行还很值得怀疑。

由于M.Minsky在人工智能领域中的巨大威望,他在论著中作出的悲观结论给当时神经网络沿感知机方向的研究泼了一盆冷水。

在《感知机》一书出版后,美国联邦基金有15年之久没有资助神经网络方面的研究工作,前苏联也取消了几项有前途的研究计划。

但是,即使在这个低潮期里,仍有一些研究者继续从事神经网络的研究工作,如美国波士顿大学的S.Grossberg、芬兰赫尔辛基技术大学的T.Kohonen以及日本东京大学的甘利俊一等人。

他们坚持不懈的工作为神经网络研究的复兴开辟了道路。4.第四阶段从八十年代初至今。

1982年,美国加州理工学院的生物物理学家J.J.Hopfield采用全互连型神经网络模型,利用所定义的计算能量函数,成功地求解了计算复杂度为NP完全型的旅行商问题(TravellingSalesmanProblem,简称TSP)。

这项突破性进展标志着神经网络方面的研究进入了第四阶段,也是蓬勃发展的阶段。Hopfield模型提出后,许多研究者力图扩展该模型,使之更接近人脑的功能特性。

1983年,T.Sejnowski和G.Hinton提出了"隐单元"的概念,并且研制出了Boltzmann机。

日本的福岛邦房在Rosenblatt的感知机的基础上,增加隐层单元,构造出了可以实现联想学习的"认知机"。Kohonen应用3000个阈器件构造神经网络实现了二维网络的联想式学习功能。

1986年,D.Rumelhart和J.McClelland出版了具有轰动性的著作《并行分布处理-认知微结构的探索》,该书的问世宣告神经网络的研究进入了高潮。

1987年,首届国际神经网络大会在圣地亚哥召开,国际神经网络联合会(INNS)成立。

随后INNS创办了刊物《JournalNeuralNetworks》,其他专业杂志如《NeuralComputation》,《IEEETransactionsonNeuralNetworks》,《InternationalJournalofNeuralSystems》等也纷纷问世。

世界上许多著名大学相继宣布成立神经计算研究所并制订有关教育计划,许多国家也陆续成立了神经网络学会,并召开了多种地区性、国际性会议,优秀论著、重大成果不断涌现。

今天,在经过多年的准备与探索之后,神经网络的研究工作已进入了决定性的阶段。日本、美国及西欧各国均制订了有关的研究规划。日本制订了一个"人类前沿科学计划"。

这项计划为期15-20年,仅初期投资就超过了1万亿日元。在该计划中,神经网络和脑功能的研究占有重要地位,因为所谓"人类前沿科学"首先指的就是有关人类大脑以及通过借鉴人脑而研制新一代计算机的科学领域。

在美国,神经网络的研究得到了军方的强有力的支持。美国国防部投资4亿美元,由国防部高级研究计划局(DAPRA)制订了一个8年研究计划,并成立了相应的组织和指导委员会。

同时,海军研究办公室(ONR)、空军科研办公室(AFOSR)等也纷纷投入巨额资金进行神经网络的研究。DARPA认为神经网络"看来是解决机器智能的唯一希望",并认为"这是一项比原子弹工程更重要的技术"。

美国国家科学基金会(NSF)、国家航空航天局(NASA)等政府机构对神经网络的发展也都非常重视,它们以不同的形式支持了众多的研究课题。欧共体也制订了相应的研究计划。

在其ESPRIT计划中,就有一个项目是"神经网络在欧洲工业中的应用",除了英、德两国的原子能机构外,还有多个欧洲大公司卷进这个研究项目,如英国航天航空公司、德国西门子公司等。

此外,西欧一些国家还有自己的研究计划,如德国从1988年就开始进行一个叫作"神经信息论"的研究计划。我国从1986年开始,先后召开了多次非正式的神经网络研讨会。

1990年12月,由中国计算机学会、电子学会、人工智能学会、自动化学会、通信学会、物理学会、生物物理学会和心理学会等八个学会联合在北京召开了"中国神经网络首届学术会议",从而开创了我国神经网络研究的新纪元。

神经网络的发展趋势如何?

。

神经网络的云集成模式还不是很成熟,应该有发展潜力,但神经网络有自己的硬伤,不知道能够达到怎样的效果,所以决策支持系统中并不是很热门,但是神经网络无视过程的优点也是无可替代的,云网络如果能够对神经网络提供一个互补的辅助决策以控制误差的话,也许就能使神经网络成熟起来1人工神经网络产生的背景自古以来,关于人类智能本源的奥秘,一直吸引着无数哲学家和自然科学家的研究热情。

生物学家、神经学家经过长期不懈的努力,通过对人脑的观察和认识,认为人脑的智能活动离不开脑的物质基础,包括它的实体结构和其中所发生的各种生物、化学、电学作用,并因此建立了神经元网络理论和神经系统结构理论,而神经元理论又是此后神经传导理论和大脑功能学说的基础。

在这些理论基础之上,科学家们认为,可以从仿制人脑神经系统的结构和功能出发,研究人类智能活动和认识现象。

另一方面,19世纪之前,无论是以欧氏几何和微积分为代表的经典数学,还是以牛顿力学为代表的经典物理学,从总体上说,这些经典科学都是线性科学。

然而,客观世界是如此的纷繁复杂,非线性情况随处可见,人脑神经系统更是如此。复杂性和非线性是连接在一起的,因此,对非线性科学的研究也是我们认识复杂系统的关键。

为了更好地认识客观世界,我们必须对非线性科学进行研究。人工神经网络作为一种非线性的、与大脑智能相似的网络模型,就这样应运而生了。

所以,人工神经网络的创立不是偶然的,而是20世纪初科学技术充分发展的产物。2人工神经网络的发展人工神经网络的研究始于40年代初。半个世纪以来,经历了兴起、高潮与萧条、高潮及稳步发展的远为曲折的道路。

1943年,心理学家W.S.Mcculloch和数理逻辑学家W.Pitts提出了M—P模型,这是第一个用数理语言描述脑的信息处理过程的模型,虽然神经元的功能比较弱,但它为以后的研究工作提供了依据。

1949年,心理学家提出突触联系可变的假设,根据这一假设提出的学习规律为神经网络的学习算法奠定了基础。

1957年,计算机科学家Rosenblatt提出了著名的感知机模型,它的模型包含了现代计算机的一些原理,是第一个完整的人工神经网络,第一次把神经网络研究付诸工程实现。

由于可应用于模式识别,联想记忆等方面,当时有上百家实验室投入此项研究,美国军方甚至认为神经网络工程应当比“原子弹工程”更重要而给予巨额资助,并在声纳信号识别等领域取得一定成绩。

1960年,B.Windrow和E.Hoff提出了自适应线性单元,它可用于自适应滤波、预测和模式识别。至此,人工神经网络的研究工作进入了第一个高潮。

1969年,美国著名人工智能学者M.Minsky和S.Papert编写了影响很大的Perceptron一书,从理论上证明单层感知机的能力有限,诸如不能解决异或问题,而且他们推测多层网络的感知机能力也不过如此,他们的分析恰似一瓢冷水,很多学者感到前途渺茫而纷纷改行,原先参与研究的实验室纷纷退出,在这之后近10年,神经网络研究进入了一个缓慢发展的萧条期。

这期间,芬兰学者T.Kohonen提出了自组织映射理论,反映了大脑神经细胞的自组织特性、记忆方式以及神经细胞兴奋刺激的规律;美国学者S.A.Grossberg的自适应共振理论(ART);日本学者K.Fukushima提出了认知机模型;ShunIchimari则致力于神经网络有关数学理论的研究等,这些研究成果对以后的神经网络的发展产生了重要影响。

美国生物物理学家J.J.Hopfield于1982年、1984年在美国科学院院刊发表的两篇文章,有力地推动了神经网络的研究,引起了研究神经网络的又一次热潮。

1982年,他提出了一个新的神经网络模型——hopfield网络模型。他在这种网络模型的研究中,首次引入了网络能量函数的概念,并给出了网络稳定性的判定依据。

1984年,他又提出了网络模型实现的电子电路,为神经网络的工程实现指明了方向,他的研究成果开拓了神经网络用于联想记忆的优化计算的新途径,并为神经计算机研究奠定了基础。

1984年Hinton等人将模拟退火算法引入到神经网络中,提出了Boltzmann机网络模型,BM网络算法为神经网络优化计算提供了一个有效的方法。

1986年,D.E.Rumelhart和J.LMcclelland提出了误差反向传播算法,成为至今为止影响很大的一种网络学习方法。

1987年美国神经计算机专家R.Hecht—Nielsen提出了对向传播神经网络,该网络具有分类灵活,算法简练的优点,可用于模式分类、函数逼近、统计分析和数据压缩等领域。

1988年L.Ochua等人提出了细胞神经网络模型,它在视觉初级加工上得到了广泛应用。为适应人工神经网络的发展,1987年成立了国际神经网络学会,并决定定期召开国际神经网络学术会议。

1988年1月NeuralNetwork创刊。1990年3月IEEETransactiononNeuralNetwork问世。

我国于1990年12月在北京召开了首届神经网络学术大会,并决定以后每年召开一次。1991年在南京成立了中国神经网络学会。IEEE与INNS联合召开的IJCNN92已在北京召开。

这些为神经网络的研究和发展起了推波助澜的作用,人工神经网络步入了稳步发展的时期。90年代初,诺贝尔奖获得者Edelman提出了Darwinism模型,建立了神经网络系统理论。

同年,Aihara等在前人推导和实验的基础上,给出了一个混沌神经元模型,该模型已成为一种经典的混沌神经网络模型,该模型可用于联想记忆。

Wunsch在90OSA年会上提出了一种AnnualMeeting,用光电执行ART,学习过程有自适应滤波和推理功能,具有快速和稳定的学习特点。

1991年,Hertz探讨了神经计算理论,对神经网络的计算复杂性分析具有重要意义;Inoue等提出用耦合的混沌振荡子作为某个神经元,构造混沌神经网络模型,为它的广泛应用前景指明了道路。

1992年,Holland用模拟生物进化的方式提出了遗传算法,用来求解复杂优化问题。1993年方建安等采用遗传算法学习,研究神经网络控制器获得了一些结果。

1994年Angeline等在前人进化策略理论的基础上,提出一种进化算法来建立反馈神经网络,成功地应用到模式识别,自动控制等方面;廖晓昕对细胞神经网络建立了新的数学理论和方法,得到了一系列结果。

HayashlY根据动物大脑中出现的振荡现象,提出了振荡神经网络。

1995年Mitra把人工神经网络与模糊逻辑理论、生物细胞学说以及概率论相结合提出了模糊神经网络,使得神经网络的研究取得了突破性进展。

Jenkins等人研究光学神经网络,建立了光学二维并行互连与电子学混合的光学神经网络,它能避免网络陷入局部最小值,并最后可达到或接近最理想的解;SoleRV等提出流体神经网络,用来研究昆虫社会,机器人集体免疫系统,启发人们用混沌理论分析社会大系统。

1996年,ShuaiJW’等模拟人脑的自发展行为,在讨论混沌神经网络的基础上提出了自发展神经网络。

1997、1998年董聪等创立和完善了广义遗传算法,解决了多层前向网络的最简拓朴构造问题和全局最优逼近问题。

随着理论工作的发展,神经网络的应用研究也取得了突破性进展,涉及面非常广泛,就应用的技术领域而言有计算机视觉,语言的识别、理解与合成,优化计算,智能控制及复杂系统分析,模式识别,神经计算机研制,知识推理专家系统与人工智能。

涉及的学科有神经生理学、认识科学、数理科学、心理学、信息科学、计算机科学、微电子学、光学、动力学、生物电子学等。美国、日本等国在神经网络计算机软硬件实现的开发方面也取得了显著的成绩,并逐步形成产品。

在美国,神经计算机产业已获得军方的强有力支持,国防部高级研究计划局认为“神经网络是解决机器智能的唯一希望”,仅一项8年神经计算机计划就投资4亿美元。

在欧洲共同体的ESPRIT计划中,就有一项特别项目:“神经网络在欧洲工业中的应用”,单是生产神经网络专用芯片这一项就投资2200万美元。据美国资料声称,日本在神经网络研究上的投资大约是美国的4倍。

我国也不甘落后,自从1990年批准了南开大学的光学神经计算机等3项课题以来,国家自然科学基金与国防预研基金也都为神经网络的研究提供资助。

另外,许多国际著名公司也纷纷卷入对神经网络的研究,如Intel、IBM、Siemens、HNC。神经计算机产品开始走向商用阶段,被国防、企业和科研部门选用。

在举世瞩目的海湾战争中,美国空军采用了神经网络来进行决策与控制。在这种刺激和需求下,人工神经网络定会取得新的突破,迎来又一个高潮。自1958年第一个神经网络诞生以来,其理论与应用成果不胜枚举。

人工神经网络是一个快速发展着的一门新兴学科,新的模型、新的理论、新的应用成果正在层出不穷地涌现出来。

3人工神经网络的发展前景针对神经网络存在的问题和社会需求,今后发展的主要方向可分为理论研究和应用研究两个方面。(1)利用神经生理与认识科学研究大脑思维及智能的机理、计算理论,带着问题研究理论。

人工神经网络提供了一种揭示智能和了解人脑工作方式的合理途径,但是由于人类起初对神经系统了解非常有限,对于自身脑结构及其活动机理的认识还十分肤浅,并且带有某种“先验”。

例如,Boltzmann机引入随机扰动来避免局部极小,有其卓越之处,然而缺乏必要的脑生理学基础,毫无疑问,人工神经网络的完善与发展要结合神经科学的研究。

而且,神经科学,心理学和认识科学等方面提出的一些重大问题,是向神经网络理论研究提出的新挑战,这些问题的解决有助于完善和发展神经网络理论。

因此利用神经生理和认识科学研究大脑思维及智能的机理,如有新的突破,将会改变智能和机器关系的认识。

利用神经科学基础理论的研究成果,用数理方法探索智能水平更高的人工神经网络模型,深入研究网络的算法和性能,如神经计算、进化计算、稳定性、收敛性、计算复杂性、容错性、鲁棒性等,开发新的网络数理理论。

由于神经网络的非线性,因此非线性问题的研究是神经网络理论发展的一个最大动力。

特别是人们发现,脑中存在着混沌现象以来,用混沌动力学启发神经网络的研究或用神经网络产生混沌成为摆在人们面前的一个新课题,因为从生理本质角度出发是研究神经网络的根本手段。

(2)神经网络软件模拟,硬件实现的研究以及神经网络在各个科学技术领域应用的研究。

由于人工神经网络可以用传统计算机模拟,也可以用集成电路芯片组成神经计算机,甚至还可以用光学的、生物芯片的方式实现,因此研制纯软件模拟,虚拟模拟和全硬件实现的电子神经网络计算机潜力巨大。

如何使神经网络计算机与传统的计算机和人工智能技术相结合也是前沿课题;如何使神经网络计算机的功能向智能化发展,研制与人脑功能相似的智能计算机,如光学神经计算机,分子神经计算机,将具有十分诱人的前景。

4哲理(1)人工神经网络打开了认识论的新领域认识与脑的问题,长期以来一直受到人们的关注,因为它不仅是有关人的心理、意识的心理学问题,也是有关人的思维活动机制的脑科学与思维科学问题,而且直接关系到对物质与意识的哲学基本问题的回答。

人工神经网络的发展使我们能够更进一步地既唯物又辩证地理解认识与脑的关系,打开认识论的新领域。

人脑是一个复杂的并行系统,它具有“认知、意识、情感”等高级脑功能,用人工进行模拟,有利于加深对思维及智能的认识,已对认知和智力的本质的研究产生了极大的推动作用。

在研究大脑的整体功能和复杂性方面,人工神经网络给人们带来了新的启迪。

由于人脑中存在混沌现象,混沌可用来理解脑中某些不规则的活动,从而混沌动力学模型能用作人对外部世界建模的工具,可用来描述人脑的信息处理过程。

混沌和智能是有关的,神经网络中引入混沌学思想有助于提示人类形象思维等方面的奥秘。

人工神经网络之所以再度兴起,关键在于它反映了事物的非线性,抓住了客观世界的本质,而且它在一定程度上正面回答了智能系统如何从环境中自主学习这一最关键的问题,从认知的角度讲,所谓学习,就是对未知现象或规律的发现和归纳。

由于神经网络具有高度的并行性,高度的非线性全局作用,良好的容错性与联想记忆功能以及十分强的自适应、自学习功能,而使得它成为揭示智能和了解人脑工作方式的合理途径。

但是,由于认知问题的复杂性,目前,我们对于脑神经网的运行和神经细胞的内部处理机制,如信息在人脑是如何传输、存贮、加工的?记忆、联想、判断是如何形成的?大脑是否存在一个操作系统?

还没有太多的认识,因此要制造人工神经网络来模仿人脑各方面的功能,还有待于人们对大脑信息处理机理认识的深化。

(2)人工神经网络发展的推动力来源于实践、理论和问题的相互作用随着人们社会实践范围的不断扩大,社会实践层次的不断深入,人们所接触到的自然现象也越来越丰富多彩、纷繁复杂,这就促使人们用不同的原因加以解释不同种类的自然现象,当不同种类的自然现象可以用同样的原因加以解释,这样就出现了不同学科的相互交叉、综合,人工神经网络就这样产生了。

在开始阶段,由于这些理论化的网络模型比较简单,还存在许多问题,而且这些模型几乎没有得到实践的检验,因而神经网络的发展比较缓慢。

随着理论研究的深入,问题逐渐地解决特别是工程上得到实现以后,如声纳识别成功,才迎来了神经网络的第一个发展高潮。

可Minisky认为感知器不能解决异或问题,多层感知器也不过如此,神经网络的研究进入了低谷,这主要是因为非线性问题没得到解决。

随着理论的不断丰富,实践的不断深入,现在已证明Minisky的悲观论调是错误的。今天,高度发达的科学技术逐渐揭示了非线性问题是客观世界的本质。

问题、理论、实践的相互作用又迎来了人工神经网络的第二次高潮。目前人工神经网络的问题是智能水平不高,还有其它理论和实现方面的问题,这就迫使人们不断地进行理论研究,不断实践,促使神经网络不断向前发展。

总之,先前的原因遇到了解释不同的新现象,促使人们提出更加普遍和精确的原因来解释。

理论是基础,实践是动力,但单纯的理论和实践的作用还不能推动人工神经网络的发展,还必须有问题提出,才能吸引科学家进入研究的特定范围,引导科学家从事相关研究,从而逼近科学发现,而后实践又提出新问题,新问题又引发新的思考,促使科学家不断思考,不断完善理论。

人工神经网络的发展无不体现着问题、理论和实践的辩证统一关系。

(3)人工神经网络发展的另一推动力来源于相关学科的贡献及不同学科专家的竞争与协同人工神经网络本身就是一门边缘学科,它的发展有更广阔的科学背景,亦即是众多科研成果的综合产物,控制论创始人Wiener在其巨著《控制论》中就进行了人脑神经元的研究;计算机科学家Turing就提出过B网络的设想;Prigogine提出非平衡系统的自组织理论,获得诺贝尔奖;Haken研究大量元件联合行动而产生宏观效果,非线性系统“混沌”态的提出及其研究等,都是研究如何通过元件间的相互作用建立复杂系统,类似于生物系统的自组织行为。

脑科学与神经科学的进展迅速反映到人工神经网络的研究中,例如生物神经网络理论,视觉中发现的侧抑制原理,感受野概念等,为神经网络的发展起了重要的推动作用。

从已提出的上百种人工神经网络模型中,涉及学科之多,令人目不暇接,其应用领域之广,令人叹为观止。不同学科专家为了在这一领域取得领先水平,存在着不同程度的竞争,所有这些有力地推动了人工神经网络的发展。

人脑是一个功能十分强大、结构异常复杂的信息系统,随着信息论、控制论、生命科学,计算机科学的发展,人们越来越惊异于大脑的奇妙,至少到目前为止,人类大脑信号处理机制对人类自身来说,仍是一个黑盒子,要揭示人脑的奥秘需要神经学家、心理学家、计算机科学家、微电子学家、数学家等专家的共同努力,对人类智能行为不断深入研究,为人工神经网络发展提供丰富的理论源泉。

另外,还要有哲学家的参与,通过哲学思想和自然科学多种学科的深层结合,逐步孕育出探索人类思维本质和规律的新方法,使思维科学从朦胧走向理性。

而且,不同领域专家的竞争与协调同有利于问题清晰化和寻求最好的解决途径。纵观神经网络的发展历史,没有相关学科的贡献,不同学科专家的竞争与协同,神经网络就不会有今天。

当然,人工神经网络在各个学科领域应用的研究反过来又推动其它学科的发展,推动自身的完善和发展。

神经网络算法的三大类分别是?

神经网络算法的三大类分别是:1、前馈神经网络:这是实际应用中最常见的神经网络类型。第一层是输入,最后一层是输出。如果有多个隐藏层,我们称之为“深度”神经网络。他们计算出一系列改变样本相似性的变换。

各层神经元的活动是前一层活动的非线性函数。2、循环网络:循环网络在他们的连接图中定向了循环,这意味着你可以按照箭头回到你开始的地方。他们可以有复杂的动态,使其很难训练。他们更具有生物真实性。

循环网络的目的是用来处理序列数据。在传统的神经网络模型中,是从输入层到隐含层再到输出层,层与层之间是全连接的,每层之间的节点是无连接的。但是这种普通的神经网络对于很多问题却无能无力。

循环神经网路,即一个序列当前的输出与前面的输出也有关。

具体的表现形式为网络会对前面的信息进行记忆并应用于当前输出的计算中,即隐藏层之间的节点不再无连接而是有连接的,并且隐藏层的输入不仅包括输入层的输出还包括上一时刻隐藏层的输出。

3、对称连接网络:对称连接网络有点像循环网络,但是单元之间的连接是对称的(它们在两个方向上权重相同)。比起循环网络,对称连接网络更容易分析。这个网络中有更多的限制,因为它们遵守能量函数定律。

没有隐藏单元的对称连接网络被称为“Hopfield网络”。有隐藏单元的对称连接的网络被称为玻尔兹曼机。

扩展资料:应用及发展:心理学家和认知科学家研究神经网络的目的在于探索人脑加工、储存和搜索信息的机制,弄清人脑功能的机理,建立人类认知过程的微结构理论。

生物学、医学、脑科学专家试图通过神经网络的研究推动脑科学向定量、精确和理论化体系发展,同时也寄希望于临床医学的新突破;信息处理和计算机科学家研究这一问题的目的在于寻求新的途径以解决不能解决或解决起来有极大困难的大量问题,构造更加逼近人脑功能的新一代计算机。

神经网络算法的人工神经网络

人工神经网络(ArtificialNeuralNetworks,ANN)系统是20世纪40年代后出现的。

它是由众多的神经元可调的连接权值连接而成,具有大规模并行处理、分布式信息存储、良好的自组织自学习能力等特点。

BP(BackPropagation)算法又称为误差反向传播算法,是人工神经网络中的一种监督式的学习算法。

BP神经网络算法在理论上可以逼近任意函数,基本的结构由非线性变化单元组成,具有很强的非线性映射能力。

而且网络的中间层数、各层的处理单元数及网络的学习系数等参数可根据具体情况设定,灵活性很大,在优化、信号处理与模式识别、智能控制、故障诊断等许多领域都有着广泛的应用前景。

人工神经元的研究起源于脑神经元学说。19世纪末,在生物、生理学领域,Waldeger等人创建了神经元学说。人们认识到复杂的神经系统是由数目繁多的神经元组合而成。

大脑皮层包括有100亿个以上的神经元,每立方毫米约有数万个,它们互相联结形成神经网络,通过感觉器官和神经接受来自身体内外的各种信息,传递至中枢神经系统内,经过对信息的分析和综合,再通过运动神经发出控制信息,以此来实现机体与内外环境的联系,协调全身的各种机能活动。

神经元也和其他类型的细胞一样,包括有细胞膜、细胞质和细胞核。但是神经细胞的形态比较特殊,具有许多突起,因此又分为细胞体、轴突和树突三部分。细胞体内有细胞核,突起的作用是传递信息。

树突是作为引入输入信号的突起,而轴突是作为输出端的突起,它只有一个。树突是细胞体的延伸部分,它由细胞体发出后逐渐变细,全长各部位都可与其他神经元的轴突末梢相互联系,形成所谓“突触”。

在突触处两神经元并未连通,它只是发生信息传递功能的结合部,联系界面之间间隙约为(15~50)×10米。突触可分为兴奋性与抑制性两种类型,它相应于神经元之间耦合的极性。

每个神经元的突触数目正常,最高可达10个。各神经元之间的连接强度和极性有所不同,并且都可调整、基于这一特性,人脑具有存储信息的功能。利用大量神经元相互联接组成人工神经网络可显示出人的大脑的某些特征。

人工神经网络是由大量的简单基本元件——神经元相互联接而成的自适应非线性动态系统。每个神经元的结构和功能比较简单,但大量神经元组合产生的系统行为却非常复杂。

人工神经网络反映了人脑功能的若干基本特性,但并非生物系统的逼真描述,只是某种模仿、简化和抽象。

与数字计算机比较,人工神经网络在构成原理和功能特点等方面更加接近人脑,它不是按给定的程序一步一步地执行运算,而是能够自身适应环境、总结规律、完成某种运算、识别或过程控制。

人工神经网络首先要以一定的学习准则进行学习,然后才能工作。现以人工神经网络对于写“A”、“B”两个字母的识别为例进行说明,规定当“A”输入网络时,应该输出“1”,而当输入为“B”时,输出为“0”。

所以网络学习的准则应该是:如果网络作出错误的的判决,则通过网络的学习,应使得网络减少下次犯同样错误的可能性。

首先,给网络的各连接权值赋予(0,1)区间内的随机值,将“A”所对应的图象模式输入给网络,网络将输入模式加权求和、与门限比较、再进行非线性运算,得到网络的输出。

在此情况下,网络输出为“1”和“0”的概率各为50%,也就是说是完全随机的。这时如果输出为“1”(结果正确),则使连接权值增大,以便使网络再次遇到“A”模式输入时,仍然能作出正确的判断。

如果输出为“0”(即结果错误),则把网络连接权值朝着减小综合输入加权值的方向调整,其目的在于使网络下次再遇到“A”模式输入时,减小犯同样错误的可能性。

如此操作调整,当给网络轮番输入若干个手写字母“A”、“B”后,经过网络按以上学习方法进行若干次学习后,网络判断的正确率将大大提高。

这说明网络对这两个模式的学习已经获得了成功,它已将这两个模式分布地记忆在网络的各个连接权值上。当网络再次遇到其中任何一个模式时,能够作出迅速、准确的判断和识别。

一般说来,网络中所含的神经元个数越多,则它能记忆、识别的模式也就越多。(1)人类大脑有很强的自适应与自组织特性,后天的学习与训练可以开发许多各具特色的活动功能。

如盲人的听觉和触觉非常灵敏;聋哑人善于运用手势;训练有素的运动员可以表现出非凡的运动技巧等等。普通计算机的功能取决于程序中给出的知识和能力。显然,对于智能活动要通过总结编制程序将十分困难。

人工神经网络也具有初步的自适应与自组织能力。在学习或训练过程中改变突触权重值,以适应周围环境的要求。同一网络因学习方式及内容不同可具有不同的功能。

人工神经网络是一个具有学习能力的系统,可以发展知识,以致超过设计者原有的知识水平。

通常,它的学习训练方式可分为两种,一种是有监督或称有导师的学习,这时利用给定的样本标准进行分类或模仿;另一种是无监督学习或称无为导师学习,这时,只规定学习方式或某些规则,则具体的学习内容随系统所处环境(即输入信号情况)而异,系统可以自动发现环境特征和规律性,具有更近似人脑的功能。

(2)泛化能力泛化能力指对没有训练过的样本,有很好的预测能力和控制能力。特别是,当存在一些有噪声的样本,网络具备很好的预测能力。

(3)非线性映射能力当对系统对于设计人员来说,很透彻或者很清楚时,则一般利用数值分析,偏微分方程等数学工具建立精确的数学模型,但当对系统很复杂,或者系统未知,系统信息量很少时,建立精确的数学模型很困难时,神经网络的非线性映射能力则表现出优势,因为它不需要对系统进行透彻的了解,但是同时能达到输入与输出的映射关系,这就大大简化设计的难度。

(4)高度并行性并行性具有一定的争议性。承认具有并行性理由:神经网络是根据人的大脑而抽象出来的数学模型,由于人可以同时做一些事,所以从功能的模拟角度上看,神经网络也应具备很强的并行性。

多少年以来,人们从医学、生物学、生理学、哲学、信息学、计算机科学、认知学、组织协同学等各个角度企图认识并解答上述问题。

在寻找上述问题答案的研究过程中,这些年来逐渐形成了一个新兴的多学科交叉技术领域,称之为“神经网络”。神经网络的研究涉及众多学科领域,这些领域互相结合、相互渗透并相互推动。

不同领域的科学家又从各自学科的兴趣与特色出发,提出不同的问题,从不同的角度进行研究。

下面将人工神经网络与通用的计算机工作特点来对比一下:若从速度的角度出发,人脑神经元之间传递信息的速度要远低于计算机,前者为毫秒量级,而后者的频率往往可达几百兆赫。

但是,由于人脑是一个大规模并行与串行组合处理系统,因而,在许多问题上可以作出快速判断、决策和处理,其速度则远高于串行结构的普通计算机。

人工神经网络的基本结构模仿人脑,具有并行处理特征,可以大大提高工作速度。人脑存贮信息的特点为利用突触效能的变化来调整存贮内容,也即信息存贮在神经元之间连接强度的分布上,存贮区与计算机区合为一体。

虽然人脑每日有大量神经细胞死亡(平均每小时约一千个),但不影响大脑的正常思维活动。

普通计算机是具有相互独立的存贮器和运算器,知识存贮与数据运算互不相关,只有通过人编出的程序使之沟通,这种沟通不能超越程序编制者的预想。元器件的局部损坏及程序中的微小错误都可能引起严重的失常。

心理学家和认知科学家研究神经网络的目的在于探索人脑加工、储存和搜索信息的机制,弄清人脑功能的机理,建立人类认知过程的微结构理论。

生物学、医学、脑科学专家试图通过神经网络的研究推动脑科学向定量、精确和理论化体系发展,同时也寄希望于临床医学的新突破;信息处理和计算机科学家研究这一问题的目的在于寻求新的途径以解决不能解决或解决起来有极大困难的大量问题,构造更加逼近人脑功能的新一代计算机。

人工神经网络早期的研究工作应追溯至上世纪40年代。下面以时间顺序,以著名的人物或某一方面突出的研究成果为线索,简要介绍人工神经网络的发展历史。

1943年,心理学家W·Mcculloch和数理逻辑学家W·Pitts在分析、总结神经元基本特性的基础上首先提出神经元的数学模型。此模型沿用至今,并且直接影响着这一领域研究的进展。

因而,他们两人可称为人工神经网络研究的先驱。1945年冯·诺依曼领导的设计小组试制成功存储程序式电子计算机,标志着电子计算机时代的开始。

1948年,他在研究工作中比较了人脑结构与存储程序式计算机的根本区别,提出了以简单神经元构成的再生自动机网络结构。

但是,由于指令存储式计算机技术的发展非常迅速,迫使他放弃了神经网络研究的新途径,继续投身于指令存储式计算机技术的研究,并在此领域作出了巨大贡献。

虽然,冯·诺依曼的名字是与普通计算机联系在一起的,但他也是人工神经网络研究的先驱之一。50年代末,F·Rosenblatt设计制作了“感知机”,它是一种多层的神经网络。

这项工作首次把人工神经网络的研究从理论探讨付诸工程实践。当时,世界上许多实验室仿效制作感知机,分别应用于文字识别、声音识别、声纳信号识别以及学习记忆问题的研究。

然而,这次人工神经网络的研究高潮未能持续很久,许多人陆续放弃了这方面的研究工作,这是因为当时数字计算机的发展处于全盛时期,许多人误以为数字计算机可以解决人工智能、模式识别、专家系统等方面的一切问题,使感知机的工作得不到重视;其次,当时的电子技术工艺水平比较落后,主要的元件是电子管或晶体管,利用它们制作的神经网络体积庞大,价格昂贵,要制作在规模上与真实的神经网络相似是完全不可能的;另外,在1968年一本名为《感知机》的著作中指出线性感知机功能是有限的,它不能解决如异感这样的基本问题,而且多层网络还不能找到有效的计算方法,这些论点促使大批研究人员对于人工神经网络的前景失去信心。

60年代末期,人工神经网络的研究进入了低潮。另外,在60年代初期,Widrow提出了自适应线性元件网络,这是一种连续取值的线性加权求和阈值网络。后来,在此基础上发展了非线性多层自适应网络。

当时,这些工作虽未标出神经网络的名称,而实际上就是一种人工神经网络模型。随着人们对感知机兴趣的衰退,神经网络的研究沉寂了相当长的时间。

80年代初期,模拟与数字混合的超大规模集成电路制作技术提高到新的水平,完全付诸实用化,此外,数字计算机的发展在若干应用领域遇到困难。这一背景预示,向人工神经网络寻求出路的时机已经成熟。

美国的物理学家Hopfield于1982年和1984年在美国科学院院刊上发表了两篇关于人工神经网络研究的论文,引起了巨大的反响。人们重新认识到神经网络的威力以及付诸应用的现实性。

随即,一大批学者和研究人员围绕着Hopfield提出的方法展开了进一步的工作,形成了80年代中期以来人工神经网络的研究热潮。

1985年,Ackley、Hinton和Sejnowski将模拟退火算法应用到神经网络训练中,提出了Boltzmann机,该算法具有逃离极值的优点,但是训练时间需要很长。

1986年,Rumelhart、Hinton和Williams提出了多层前馈神经网络的学习算法,即BP算法。它从证明的角度推导算法的正确性,是学习算法有理论依据。从学习算法角度上看,是一个很大的进步。

1988年,Broomhead和Lowe第一次提出了径向基网络:RBF网络。总体来说,神经网络经历了从高潮到低谷,再到高潮的阶段,充满曲折的过程。

人工神经网络的发展趋势

人工神经网络特有的非线性适应性信息处理能力,克服了传统人工智能方法对于直觉,如模式、语音识别、非结构化信息处理方面的缺陷,使之在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用。

人工神经网络与其它传统方法相结合,将推动人工智能和信息处理技术不断发展。

近年来,人工神经网络正向模拟人类认知的道路上更加深入发展,与模糊系统、遗传算法、进化机制等结合,形成计算智能,成为人工智能的一个重要方向,将在实际应用中得到发展。

将信息几何应用于人工神经网络的研究,为人工神经网络的理论研究开辟了新的途径。神经计算机的研究发展很快,已有产品进入市场。光电结合的神经计算机为人工神经网络的发展提供了良好条件。

神经网络在很多领域已得到了很好的应用,但其需要研究的方面还很多。

其中,具有分布存储、并行处理、自学习、自组织以及非线性映射等优点的神经网络与其他技术的结合以及由此而来的混合方法和混合系统,已经成为一大研究热点。

由于其他方法也有它们各自的优点,所以将神经网络与其他方法相结合,取长补短,继而可以获得更好的应用效果。

目前这方面工作有神经网络与模糊逻辑、专家系统、遗传算法、小波分析、混沌、粗集理论、分形理论、证据理论和灰色系统等的融合。下面主要就神经网络与小波分析、混沌、粗集理论、分形理论的融合进行分析。

与小波分析的结合1981年,法国地质学家Morlet在寻求地质数据时,通过对Fourier变换与加窗Fourier变换的异同、特点及函数构造进行创造性的研究,首次提出了小波分析的概念,建立了以他的名字命名的Morlet小波。

1986年以来由于YMeyer、S.Mallat及IDaubechies等的奠基工作,小波分析迅速发展成为一门新兴学科。

Meyer所著的小波与算子,Daubechies所著的小波十讲是小波研究领域最权威的著作。小波变换是对Fourier分析方法的突破。

它不但在时域和频域同时具有良好的局部化性质,而且对低频信号在频域和对高频信号在时域里都有很好的分辨率,从而可以聚集到对象的任意细节。

小波分析相当于一个数学显微镜,具有放大、缩小和平移功能,通过检查不同放大倍数下的变化来研究信号的动态特性。因此,小波分析已成为地球物理、信号处理、图像处理、理论物理等诸多领域的强有力工具。

小波神经网络将小波变换良好的时频局域化特性和神经网络的自学习功能相结合,因而具有较强的逼近能力和容错能力。

在结合方法上,可以将小波函数作为基函数构造神经网络形成小波网络,或者小波变换作为前馈神经网络的输入前置处理工具,即以小波变换的多分辨率特性对过程状态信号进行处理,实现信噪分离,并提取出对加工误差影响最大的状态特性,作为神经网络的输入。

小波神经网络在电机故障诊断、高压电网故障信号处理与保护研究、轴承等机械故障诊断以及许多方面都有应用,将小波神经网络用于感应伺服电机的智能控制,使该系统具有良好的跟踪控制性能,以及好的鲁棒性,利用小波包神经网络进行心血管疾病的智能诊断,小波层进行时频域的自适应特征提取,前向神经网络用来进行分类,正确分类率达到94%。

小波神经网络虽然应用于很多方面,但仍存在一些不足。从提取精度和小波变换实时性的要求出发,有必要根据实际情况构造一些适应应用需求的特殊小波基,以便在应用中取得更好的效果。

另外,在应用中的实时性要求,也需要结合DSP的发展,开发专门的处理芯片,从而满足这方面的要求。混沌神经网络混沌第一个定义是上世纪70年代才被Li-Yorke第一次提出的。

由于它具有广泛的应用价值,自它出现以来就受到各方面的普遍关注。

混沌是一种确定的系统中出现的无规则的运动,混沌是存在于非线性系统中的一种较为普遍的现象,混沌运动具有遍历性、随机性等特点,能在一定的范围内按其自身规律不重复地遍历所有状态。

混沌理论所决定的是非线性动力学混沌,目的是揭示貌似随机的现象背后可能隐藏的简单规律,以求发现一大类复杂问题普遍遵循的共同规律。

1990年Kaihara、T.Takabe和M.Toyoda等人根据生物神经元的混沌特性首次提出混沌神经网络模型,将混沌学引入神经网络中,使得人工神经网络具有混沌行为,更加接近实际的人脑神经网络,因而混沌神经网络被认为是可实现其真实世界计算的智能信息处理系统之一,成为神经网络的主要研究方向之一。

与常规的离散型Hopfield神经网络相比较,混沌神经网络具有更丰富的非线性动力学特性,主要表现如下:在神经网络中引入混沌动力学行为;混沌神经网络的同步特性;混沌神经网络的吸引子。

当神经网络实际应用中,网络输入发生较大变异时,应用网络的固有容错能力往往感到不足,经常会发生失忆现象。

混沌神经网络动态记忆属于确定性动力学运动,记忆发生在混沌吸引子的轨迹上,通过不断地运动(回忆过程)一一联想到记忆模式,特别对于那些状态空间分布的较接近或者发生部分重叠的记忆模式,混沌神经网络总能通过动态联想记忆加以重现和辨识,而不发生混淆,这是混沌神经网络所特有的性能,它将大大改善Hopfield神经网络的记忆能力。

混沌吸引子的吸引域存在,形成了混沌神经网络固有容错功能。这将对复杂的模式识别、图像处理等工程应用发挥重要作用。

混沌神经网络受到关注的另一个原因是混沌存在于生物体真实神经元及神经网络中,并且起到一定的作用,动物学的电生理实验已证实了这一点。

混沌神经网络由于其复杂的动力学特性,在动态联想记忆、系统优化、信息处理、人工智能等领域受到人们极大的关注。

针对混沌神经网络具有联想记忆功能,但其搜索过程不稳定,提出了一种控制方法可以对混沌神经网络中的混沌现象进行控制。研究了混沌神经网络在组合优化问题中的应用。

为了更好的应用混沌神经网络的动力学特性,并对其存在的混沌现象进行有效的控制,仍需要对混沌神经网络的结构进行进一步的改进和调整,以及混沌神经网络算法的进一步研究。

基于粗集理论粗糙集(RoughSets)理论是1982年由波兰华沙理工大学教授Z.Pawlak首先提出,它是一个分析数据的数学理论,研究不完整数据、不精确知识的表达、学习、归纳等方法。

粗糙集理论是一种新的处理模糊和不确定性知识的数学工具,其主要思想就是在保持分类能力不变的前提下,通过知识约简,导出问题的决策或分类规则。

目前,粗糙集理论已被成功应用于机器学习、决策分析、过程控制、模式识别与数据挖掘等领域。

粗集和神经网络的共同点是都能在自然环境下很好的工作,但是,粗集理论方法模拟人类的抽象逻辑思维,而神经网络方法模拟形象直觉思维,因而二者又具有不同特点。

粗集理论方法以各种更接近人们对事物的描述方式的定性、定量或者混合性信息为输入,输入空间与输出空间的映射关系是通过简单的决策表简化得到的,它考虑知识表达中不同属性的重要性确定哪些知识是冗余的,哪些知识是有用的,神经网络则是利用非线性映射的思想和并行处理的方法,用神经网络本身结构表达输入与输出关联知识的隐函数编码。

在粗集理论方法和神经网络方法处理信息中,两者存在很大的两个区别:其一是神经网络处理信息一般不能将输入信息空间维数简化,当输入信息空间维数较大时,网络不仅结构复杂,而且训练时间也很长;而粗集方法却能通过发现数据间的关系,不仅可以去掉冗余输入信息,而且可以简化输入信息的表达空间维数。

其二是粗集方法在实际问题的处理中对噪声较敏感,因而用无噪声的训练样本学习推理的结果在有噪声的环境中应用效果不佳。而神经网络方法有较好的抑制噪声干扰的能力。

因此将两者结合起来,用粗集方法先对信息进行预处理,即把粗集网络作为前置系统,再根据粗集方法预处理后的信息结构,构成神经网络信息处理系统。

通过二者的结合,不但可减少信息表达的属性数量,减小神经网络构成系统的复杂性,而且具有较强的容错及抗干扰能力,为处理不确定、不完整信息提供了一条强有力的途径。

目前粗集与神经网络的结合已应用于语音识别、专家系统、数据挖掘、故障诊断等领域,将神经网络和粗集用于声源位置的自动识别,将神经网络和粗集用于专家系统的知识获取中,取得比传统专家系统更好的效果,其中粗集进行不确定和不精确数据的处理,神经网络进行分类工作。

虽然粗集与神经网络的结合已应用于许多领域的研究,为使这一方法发挥更大的作用还需考虑如下问题:模拟人类抽象逻辑思维的粗集理论方法和模拟形象直觉思维的神经网络方法更加有效的结合;二者集成的软件和硬件平台的开发,提高其实用性。

与分形理论的结合自从美国哈佛大学数学系教授BenoitB.Mandelbrot于20世纪70年代中期引入分形这一概念,分形几何学(Fractalgeometry)已经发展成为科学的方法论--分形理论,且被誉为开创了20世纪数学重要阶段。

现已被广泛应用于自然科学和社会科学的几乎所有领域,成为现今国际上许多学科的前沿研究课题之一。由于在许多学科中的迅速发展,分形已成为一门描述自然界中许多不规则事物的规律性的学科。

它已被广泛应用在生物学、地球地理学、天文学、计算机图形学等各个领域。

用分形理论来解释自然界中那些不规则、不稳定和具有高度复杂结构的现象,可以收到显著的效果,而将神经网络与分形理论相结合,充分利用神经网络非线性映射、计算能力、自适应等优点,可以取得更好的效果。

分形神经网络的应用领域有图像识别、图像编码、图像压缩,以及机械设备系统的故障诊断等。

分形图像压缩/解压缩方法有着高压缩率和低遗失率的优点,但运算能力不强,由于神经网络具有并行运算的特点,将神经网络用于分形图像压缩/解压缩中,提高了原有方法的运算能力。

将神经网络与分形相结合用于果实形状的识别,首先利用分形得到几种水果轮廓数据的不规则性,然后利用3层神经网络对这些数据进行辨识,继而对其不规则性进行评价。

分形神经网络已取得了许多应用,但仍有些问题值得进一步研究:分形维数的物理意义;分形的计算机仿真和实际应用研究。随着研究的不断深入,分形神经网络必将得到不断的完善,并取得更好的应用效果。?。

什么叫神经网络?

南搞小孩给出基本的概念:一.一些基本常识和原理[什么叫神经网络?]人的思维有逻辑性和直观性两种不同的基本方式。

逻辑性的思维是指根据逻辑规则进行推理的过程;它先将信息化成概念,并用符号表示,然后,根据符号运算按串行模式进行逻辑推理;这一过程可以写成串行的指令,让计算机执行。

然而,直观性的思维是将分布式存储的信息综合起来,结果是忽然间产生想法或解决问题的办法。

这种思维方式的根本之点在于以下两点:1.信息是通过神经元上的兴奋模式分布储在网络上;2.信息处理是通过神经元之间同时相互作用的动态过程来完成的。人工神经网络就是模拟人思维的第二种方式。

这是一个非线性动力学系统,其特色在于信息的分布式存储和并行协同处理。虽然单个神经元的结构极其简单,功能有限,但大量神经元构成的网络系统所能实现的行为却是极其丰富多彩的。

[人工神经网络的工作原理]人工神经网络首先要以一定的学习准则进行学习,然后才能工作。

现以人工神经网络对手写“A”、“B”两个字母的识别为例进行说明,规定当“A”输入网络时,应该输出“1”,而当输入为“B”时,输出为“0”。

所以网络学习的准则应该是:如果网络作出错误的的判决,则通过网络的学习,应使得网络减少下次犯同样错误的可能性。

首先,给网络的各连接权值赋予(0,1)区间内的随机值,将“A”所对应的图象模式输入给网络,网络将输入模式加权求和、与门限比较、再进行非线性运算,得到网络的输出。

在此情况下,网络输出为“1”和“0”的概率各为50%,也就是说是完全随机的。这时如果输出为“1”(结果正确),则使连接权值增大,以便使网络再次遇到“A”模式输入时,仍然能作出正确的判断。

如果输出为“0”(即结果错误),则把网络连接权值朝着减小综合输入加权值的方向调整,其目的在于使网络下次再遇到“A”模式输入时,减小犯同样错误的可能性。

如此操作调整,当给网络轮番输入若干个手写字母“A”、“B”后,经过网络按以上学习方法进行若干次学习后,网络判断的正确率将大大提高。

这说明网络对这两个模式的学习已经获得了成功,它已将这两个模式分布地记忆在网络的各个连接权值上。当网络再次遇到其中任何一个模式时,能够作出迅速、准确的判断和识别。

一般说来,网络中所含的神经元个数越多,则它能记忆、识别的模式也就越多。

南搞小孩一个小程序:关于一个神经网络模拟程序的下载人工神经网络实验系统(BP网络)V1.0Beta作者:沈琦作者关于此程序的说明:从输出结果可以看到,前3条"学习"指令,使"输出"神经元收敛到了值0.515974。

而后3条"学习"指令,其收敛到了值0.520051。再看看处理4和11的指令结果P*Out1:0.520051看到了吗?"大脑"识别出了4和11是属于第二类的!

怎么样?很神奇吧?再打show指令看看吧!"神经网络"已经形成了!你可以自己任意的设"模式"让这个"大脑"学习分辩哦!只要样本数据量充分(可含有误差的样本),如果能够在out数据上收敛地话,那它就能分辨地很准哦!有时不是绝对精确,因为它具有"模糊处理"的特性.看Process输出的值接近哪个Learning的值就是"大脑"作出的"模糊性"判别!南搞小孩神经网络研究社区:人工神经网络论坛(旧版,枫舞推荐)国际神经网络学会(INNS)(英文)欧洲神经网络学会(ENNS)(英文)亚太神经网络学会(APNNA)(英文)日本神经网络学会(JNNS)(日文)国际电气工程师协会神经网络分会研学论坛神经网络;sty=1&age=0人工智能研究者俱乐部2nsoft人工神经网络中文站=南搞小孩推荐部分书籍:人工神经网络技术入门讲稿(PDF)神经网络FAQ(英文)数字神经网络系统(电子图书)神经网络导论(英文)=南搞小孩还找到一份很有参考价值的讲座是Powerpoint文件,比较大,如果网速不够最好用鼠标右键下载另存.南搞小孩添言:很久之前,枫舞梦想智能机器人从自己手中诞生,SO在学专业的时候也有往这方面发展...考研的时候亦是朝着人工智能的方向发展..但是很不幸的是枫舞考研失败只好放弃这个美好的愿望,为生活奔波.希望你能够成为一个好的智能计算机工程师..枫舞已经努力的在给你提供条件资源哦~~。

边栏推荐

- Embedded Development: Embedded Basics - Mapping Peripherals Using Arrays of Pointers

- LeetCode-876. Middle of the Linked List

- Bitwarden:免费、开源的密码管理服务

- 【硬件架构的艺术】学习笔记(4)流水线的艺术

- glui.h无法找到描述+解决+测试

- C:枚举的优缺

- 山西:一煤矿发生死亡1人安全事故 被责令停产整顿

- 清理空的 Jetpack Compose 应用程序模板

- Shanxi: 1 death occurred in a coal mine safety accidents was ordered to halt production

- 分享几个自动化测试的练手项目

猜你喜欢

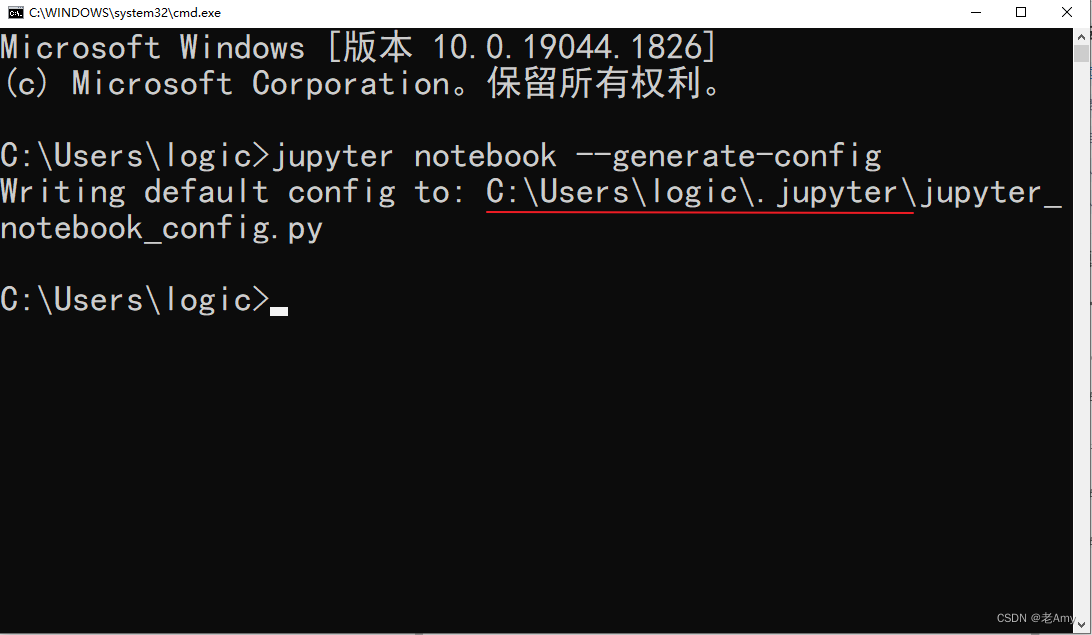

最详解决:jupyter notebook不会自动打开浏览器问题

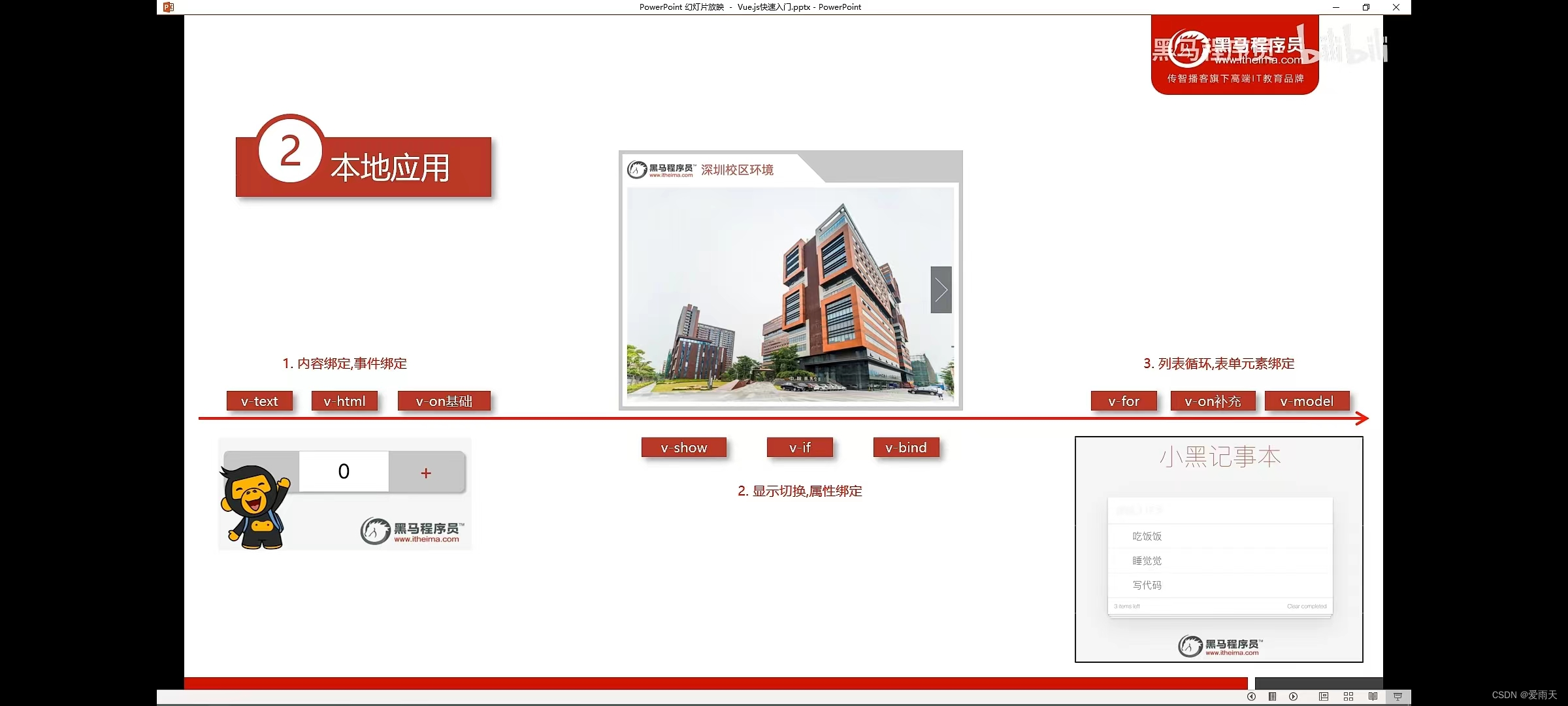

v-show指令:切换元素的显示与隐藏

电力系统潮流计算(牛顿-拉夫逊法、高斯-赛德尔法、快速解耦法)【6节点 9节点 14节点 26节点 30节点 57节点】(Matlab代码实现)

积分可以当钱用,阿里推出个人「碳账户」

How to use bitwise operators in C language

怎么截取视频做gif动图?手把手教你视频在线转gif制作

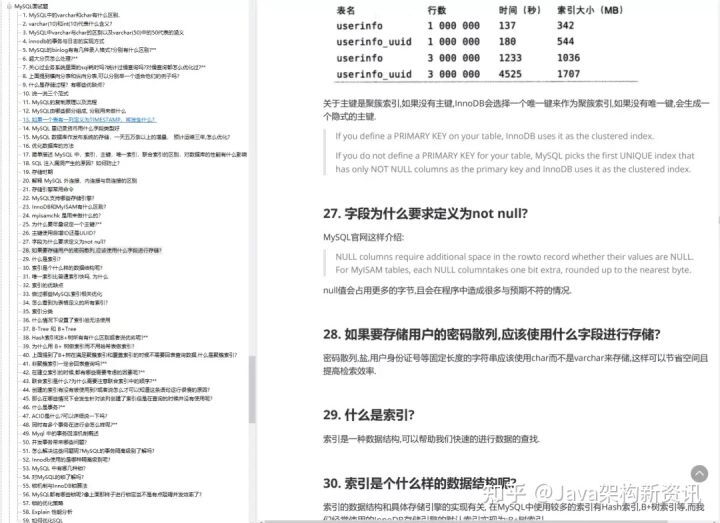

年薪60万+?这份10万字的面试突击宝典涵盖阿里 P5 工程师~P7 所有技术栈

WIZnet 物联网设计大赛 - WizFi360大赛延迟通知

如何修改gif图片尺寸?教你一键裁剪gif尺寸

2022 CCF China Open Source Conference Notice (Fourth Round)

随机推荐

x86 与 x64 架构下函数参数传递的区别【汇编语言】

MySQL的使用演示及操作,MySQL数据字符集的设置

promise笔记(四)

电力系统潮流计算与PowerWorld仿真(牛顿拉夫逊法和高斯赛德尔法)(Matlab实现)

ahx文件转mav文件 工具分享及说明

C专家编程 第10章 再论指针 10.3 在锯齿状数组上使用指针

LeetCode-2. Add Two Numbers

1001 A+B Format(字符串处理)

怎么学自动化测试

软件配置 | pip下载第三方库文件及配置pip源的不完全总结

app自动化测试webview怎么操作

Andorid源码编译需要掌握的shell语法(三)

FTXUI基础笔记(hello world)

自助服务知识库是什么?

轮询以及webSocket与socket.io原理

promise笔记(二)

一张图快速了解 Istio 的 EnvoyFilter

C专家编程 第10章 再论指针 10.5 使用指针向函数传递一个多维数组

Etcd Kubernetes 集群稳定性:LIST 请求源码分析、性能评估与大规模基础服务部署调优

雷达人体存在感应器,人体感知控制应用,为客户提供真实的感知方案