论文链接:

代码链接:

图学习模型广泛应用于科学领域,例如物理学和生物化)。对于科学家来说,相比于建立准确的预测模型,从诱发某些预测的数据中发现模式更为重要。最近,图神经网络(GNN)由于其强大的表达能力几乎成为了主流的图学习模型。然而,它们的表现力通常建立在不规则图特征的高度非线性纠缠之上。因此,从 GNN 用于进行预测的数据中找出模式通常十分具有挑战性。

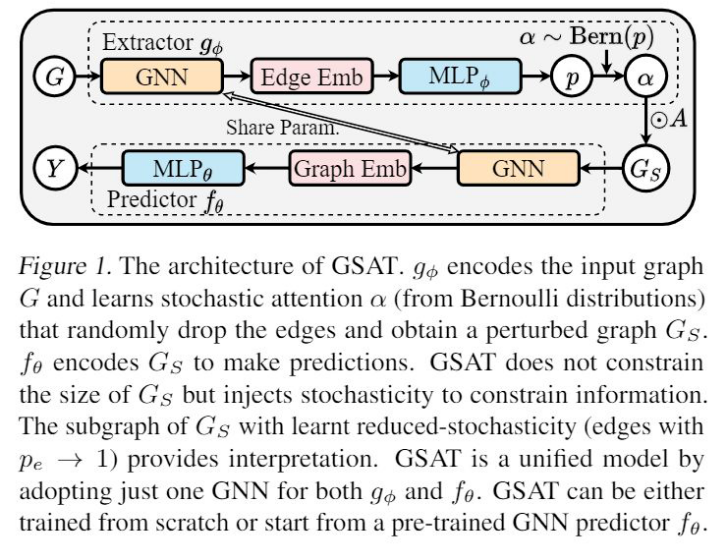

本文通过提出 Graph Stochastic Attention(GSAT)来迎接上述挑战,GSAT 是一种新颖的注意力机制,用于构建具有内在可解释性和良好泛化性的 GNN。GSAT 的基本原理源于信息瓶颈(IB)的概念。研究通过将随机性注入到注意力中来将注意力制定为 IB,以约束从输入图到预测的信息流。与标签无关的图组件的这种随机性将在训练期间保持,而与标签相关的图组件的随机性可以自动减少。这种差异最终提供了模型解释。