当前位置:网站首页>卷积神经网络梯度消失,神经网络中梯度的概念

卷积神经网络梯度消失,神经网络中梯度的概念

2022-08-11 09:24:00 【阳阳2013哈哈】

什么是梯度消失?如何加快梯度下降的速度

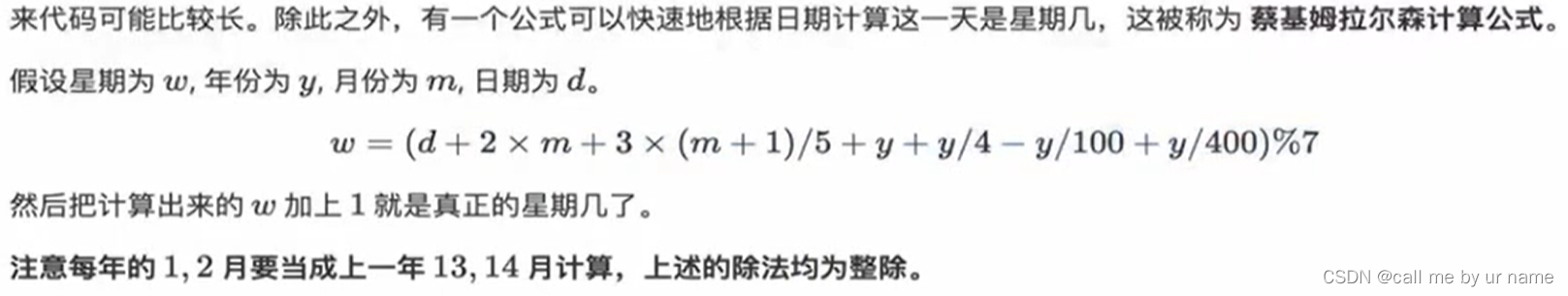

累乘中一个梯度小于1,那么不断累乘,这个值会越来越小,梯度衰减很大,迅速接近0。在神经网络中是离输出层近的参数,梯度越大,远的参数,梯度越接近0。根本原因是sigmoid函数的缺陷。

方法:1、好的初始化方法,逐层预训练,后向传播微调。2、换激活函数,用relu,leaky——relu。靠的是使梯度靠近1或等于1,避免了在累乘过程中,结果迅速衰减。

避免梯度消失和梯度爆炸的方案:使用新的激活函数Sigmoid函数和双曲正切函数都会导致梯度消失的问题。ReLU函数当x<0,的时候一样会导致无法学习。

利用一些改进的ReLU可以在一定程度上避免梯度消失的问题。例如,ELU和LeakyReLU,这些都是ReLU的变体。

深度学习中如何防止梯度消失与梯度爆炸?

为什么deep learning 能抑制梯度消失或者爆炸的问题

肯定要学会神经网络啊,因为深度学习本身就是神经网络算法,之所以叫深度学习是为了突出深度这个词。这个深度代表很多的神经网络的层数。

因为以前所说的神经网络算法没有好的训练方法,最终训练的神经网络有2到3层就是极限了,对于很多应用来说没有实际价值。

以前的主流神经网络训练方法叫反向传播,但是也解决不了随着神经网络层数的增加而梯度消失的问题。

在2006年由GeffryHiton提出使用逐层贪婪预训练的方式,使得神经网络可以高效的训练,层数可以达到很多层,加上云计算在计算能力上的主推,使得神经网络有了很大的实用价值。

你初学的话只要知道深度学习就是神经网络,只是深度上有突破就可以了。可以参考小面的文章。

深度学习之损失函数与激活函数的选择

深度学习之损失函数与激活函数的选择在深度神经网络(DNN)反向传播算法(BP)中,我们对DNN的前向反向传播算法的使用做了总结。其中使用的损失函数是均方差,而激活函数是Sigmoid。

实际上DNN可以使用的损失函数和激活函数不少。这些损失函数和激活函数如何选择呢?以下是本文的内容。MSE损失+Sigmoid激活函数的问题先来看看均方差+Sigmoid的组合有什么问题。

回顾下Sigmoid激活函数的表达式为:函数图像如下:从图上可以看出,对于Sigmoid,当z的取值越来越大后,函数曲线变得越来越平缓,意味着此时的导数σ′(z)也越来越小。

同样的,当z的取值越来越小时,也有这个问题。仅仅在z取值为0附近时,导数σ′(z)的取值较大。在均方差+Sigmoid的反向传播算法中,每一层向前递推都要乘以σ′(z),得到梯度变化值。

Sigmoid的这个曲线意味着在大多数时候,我们的梯度变化值很小,导致我们的W,b更新到极值的速度较慢,也就是我们的算法收敛速度较慢。那么有什么什么办法可以改进呢?

交叉熵损失+Sigmoid改进收敛速度Sigmoid的函数特性导致反向传播算法收敛速度慢的问题,那么如何改进呢?换掉Sigmoid?这当然是一种选择。

另一种常见的选择是用交叉熵损失函数来代替均方差损失函数。每个样本的交叉熵损失函数的形式:其中,?为向量内积。

这个形式其实很熟悉,在逻辑回归原理小结中其实我们就用到了类似的形式,只是当时我们是用最大似然估计推导出来的,而这个损失函数的学名叫交叉熵。

使用了交叉熵损失函数,就能解决Sigmoid函数导数变化大多数时候反向传播算法慢的问题吗?我们来看看当使用交叉熵时,我们输出层δL的梯度情况。

对比一下均方差损失函数时在δL梯度使用交叉熵,得到的的δl梯度表达式没有了σ′(z),梯度为预测值和真实值的差距,这样求得的Wl,bl的梯度也不包含σ′(z),因此避免了反向传播收敛速度慢的问题。

通常情况下,如果我们使用了sigmoid激活函数,交叉熵损失函数肯定比均方差损失函数好用。

对数似然损失+softmax进行分类输出在前面我们都假设输出是连续可导的值,但是如果是分类问题,那么输出是一个个的类别,那我们怎么用DNN来解决这个问题呢?

DNN分类模型要求是输出层神经元输出的值在0到1之间,同时所有输出值之和为1。很明显,现有的普通DNN是无法满足这个要求的。但是我们只需要对现有的全连接DNN稍作改良,即可用于解决分类问题。

在现有的DNN模型中,我们可以将输出层第i个神经元的激活函数定义为如下形式:这个方法很简洁漂亮,仅仅只需要将输出层的激活函数从Sigmoid之类的函数转变为上式的激活函数即可。

上式这个激活函数就是我们的softmax激活函数。它在分类问题中有广泛的应用。将DNN用于分类问题,在输出层用softmax激活函数也是最常见的了。

对于用于分类的softmax激活函数,对应的损失函数一般都是用对数似然函数,即:其中yk的取值为0或者1,如果某一训练样本的输出为第i类。则yi=1,其余的j≠i都有yj=0。

由于每个样本只属于一个类别,所以这个对数似然函数可以简化为:可见损失函数只和真实类别对应的输出有关,这样假设真实类别是第i类,则其他不属于第i类序号对应的神经元的梯度导数直接为0。

对于真实类别第i类,它的WiL对应的梯度计算为:可见,梯度计算也很简洁,也没有第一节说的训练速度慢的问题。

当softmax输出层的反向传播计算完以后,后面的普通DNN层的反向传播计算和之前讲的普通DNN没有区别。梯度爆炸or消失与ReLU学习DNN,大家一定听说过梯度爆炸和梯度消失两个词。

尤其是梯度消失,是限制DNN与深度学习的一个关键障碍,目前也没有完全攻克。什么是梯度爆炸和梯度消失呢?

简单理解,就是在反向传播的算法过程中,由于我们使用了是矩阵求导的链式法则,有一大串连乘,如果连乘的数字在每层都是小于1的,则梯度越往前乘越小,导致梯度消失,而如果连乘的数字在每层都是大于1的,则梯度越往前乘越大,导致梯度爆炸。

比如如下的梯度计算:如果不巧我们的样本导致每一层的梯度都小于1,则随着反向传播算法的进行,我们的δl会随着层数越来越小,甚至接近越0,导致梯度几乎消失,进而导致前面的隐藏层的W,b参数随着迭代的进行,几乎没有大的改变,更谈不上收敛了。

这个问题目前没有完美的解决办法。而对于梯度爆炸,则一般可以通过调整我们DNN模型中的初始化参数得以解决。

对于无法完美解决的梯度消失问题,一个可能部分解决梯度消失问题的办法是使用ReLU(RectifiedLinearUnit)激活函数,ReLU在卷积神经网络CNN中得到了广泛的应用,在CNN中梯度消失似乎不再是问题。

那么它是什么样子呢?其实很简单,比我们前面提到的所有激活函数都简单,表达式为:也就是说大于等于0则不变,小于0则激活后为0。

其他激活函数DNN常用的激活函数还有:tanh这个是sigmoid的变种,表达式为:tanh激活函数和sigmoid激活函数的关系为:tanh和sigmoid对比主要的特点是它的输出落在了[-1,1],这样输出可以进行标准化。

同时tanh的曲线在较大时变得平坦的幅度没有sigmoid那么大,这样求梯度变化值有一些优势。当然,要说tanh一定比sigmoid好倒不一定,还是要具体问题具体分析。

softplus这个其实就是sigmoid函数的原函数,表达式为:它的导数就是sigmoid函数。softplus的函数图像和ReLU有些类似。它出现的比ReLU早,可以视为ReLU的鼻祖。

PReLU从名字就可以看出它是ReLU的变种,特点是如果未激活值小于0,不是简单粗暴的直接变为0,而是进行一定幅度的缩小。如下图。

小结上面我们对DNN损失函数和激活函数做了详细的讨论,重要的点有:1)如果使用sigmoid激活函数,则交叉熵损失函数一般肯定比均方差损失函数好;2)如果是DNN用于分类,则一般在输出层使用softmax激活函数和对数似然损失函数;3)ReLU激活函数对梯度消失问题有一定程度的解决,尤其是在CNN模型中。

神经网络为什么要有激活函数,为什么relu 能够防止梯度消失

增加网络的非线性能力,从而拟合更多的非线性过程。ReLU在一定程度上能够防止梯度消失,但防止梯度消失不是用它的主要原因,主要原因是求导数简单。

一定程度是指,右端的不会趋近于饱和,求导数时,导数不为零,从而梯度不消失,但左端问题依然存在,一样掉进去梯度也会消失。所以出现很多改进的ReLU。

解释sigmoid为什么会导致梯度消失

多层感知机解决了之前无法模拟异或逻辑的缺陷,同时更多的层数也让网络更能够刻画现实世界中的复杂情形。理论上而言,参数越多的模型复杂度越高,“容量”也就越大,也就意味着它能完成更复杂的学习任务。

多层感知机给我们带来的启示是,神经网络的层数直接决定了它对现实的刻画能力——利用每层更少的神经元拟合更加复杂的函数。

但是随着神经网络层数的加深,优化函数越来越容易陷入局部最优解(即过拟合,在训练样本上有很好的拟合效果,但是在测试集上效果很差),并且这个“陷阱”越来越偏离真正的全局最优。

利用有限数据训练的深层网络,性能还不如较浅层网络。同时,另一个不可忽略的问题是随着网络层数增加,“梯度消失”(或者说是梯度发散diverge)现象更加严重。

具体来说,我们常常使用sigmoid作为神经元的输入输出函数。对于幅度为1的信号,在BP反向传播梯度时,每传递一层,梯度衰减为原来的0.25。层数一多,梯度指数衰减后低层基本上接受不到有效的训练信号。

这个神经网络训练有没有梯度消失,或者梯度爆炸,具体怎么看阿?

增加网络的非线性能力,从而拟合更多的非线性过程。ReLU在一定程度上能够防止梯度消失,但防止梯度消失不是用它的主要原因,主要原因是求导数简单。

一定程度是指,右端的不会趋近于饱和,求导数时,导数不为零,从而梯度不消失,但左端问题依然存在,一样掉进去梯度也会消失。所以出现很多改进的ReLU。

深度学习不就是神经网络吗

边栏推荐

- 四级独创的阅读词汇表

- 力扣题解8/10

- WooCommerce电子商务WordPress插件-赚美国人的钱

- 1.3版本自定义TrainOneStepCell报错

- redis模拟面试

- 基于consul的注册发现的微服务架构迁移到servicemesh

- IPQ4019/IPQ4029 support WiFi6 MiniPCIe Module 2T2R 2×2.4GHz 2x5GHz MT7915 MT7975

- 企业展厅制作要具备的六大功能

- Software custom development - the advantages of enterprise custom development of app software

- snapshot standby switch

猜你喜欢

Redis的客户端连接的可视化管理工具

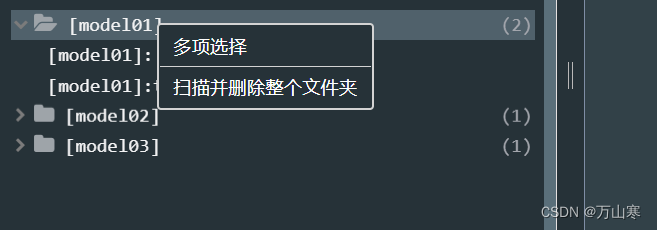

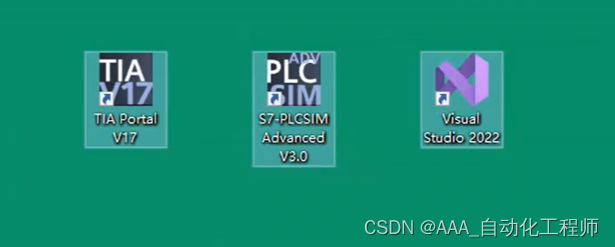

基于C#通过PLCSIM ADV仿真软件实现与西门子1500PLC的S7通信方法演示

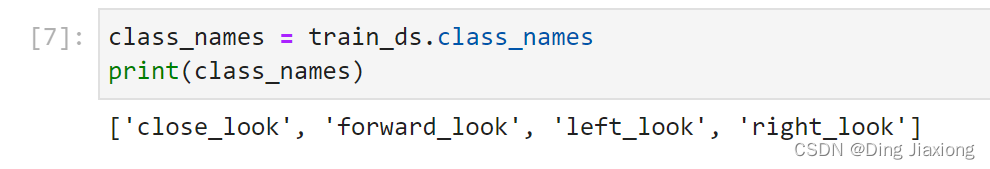

深度学习100例 —— 卷积神经网络(CNN)识别眼睛状态

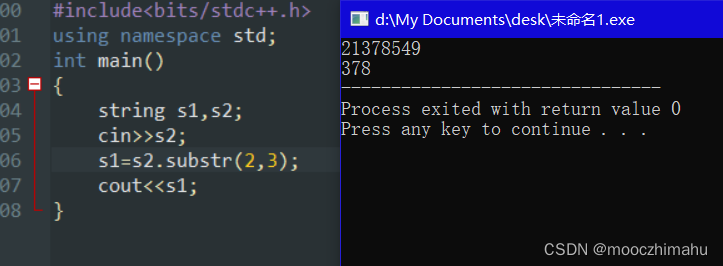

中国电子学会五级考点详解(一)-string类型字符串

数组、字符串、日期笔记【蓝桥杯】

WordpressCMS主题开发01-首页制作

mysql数据查询因为查询的时间跨度过大导致cup爆满应该怎么办

软件定制开发——企业定制开发app软件的优势

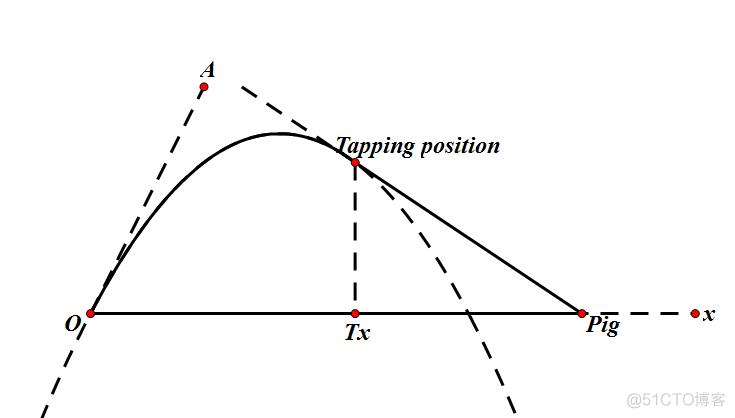

SDUT 2877: angry_birds_again_and_again

Continuous Integration/Continuous Deployment (2) Jenkins & SonarQube

随机推荐

基于hydra库实现yaml配置文件的读取(支持命令行参数)

Detailed Explanation of the Level 5 Test Center of the Chinese Institute of Electronics (1)-string type string

基于consul的注册发现的微服务架构迁移到servicemesh

unity shader 测试执行时间

Birth of the Go language

5分钟快速为OpenHarmony提交PR(Web)

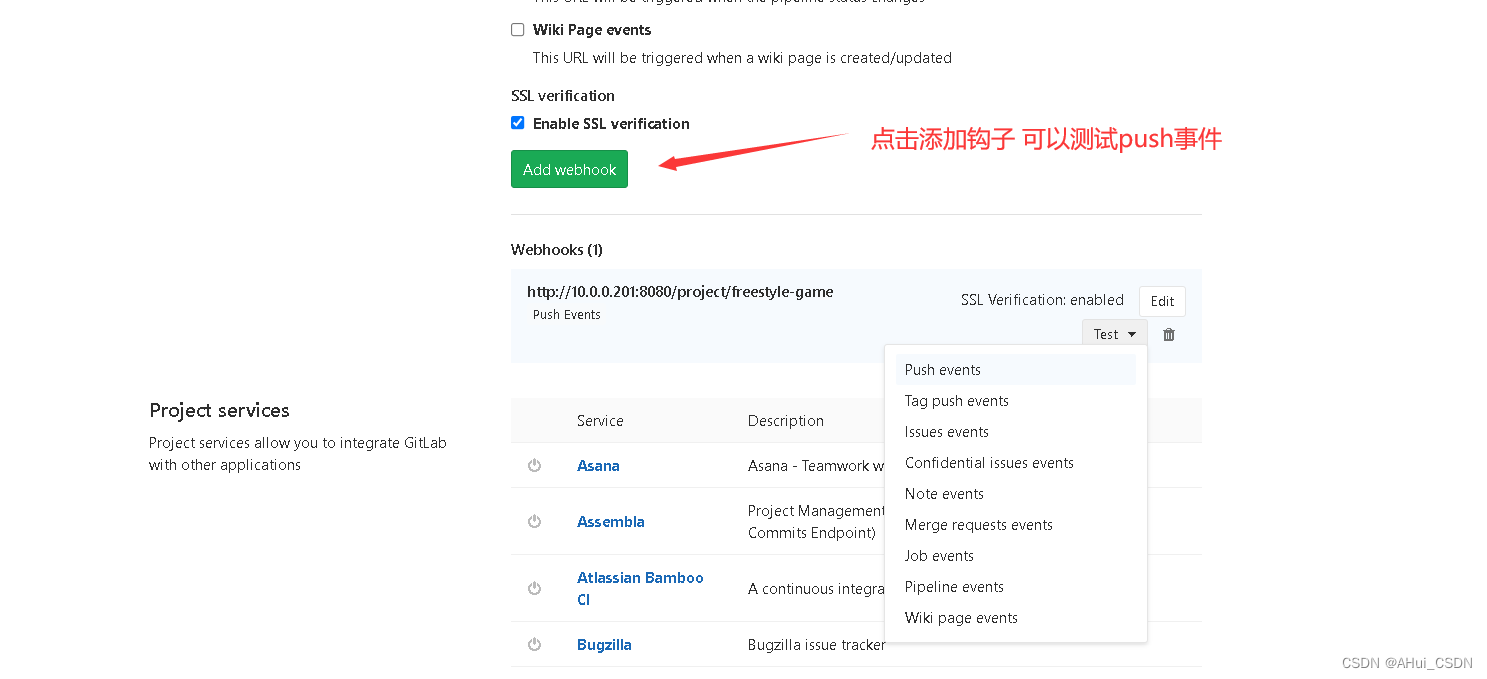

Continuous Integration/Continuous Deployment (2) Jenkins & SonarQube

pycharm cancel msyql expression highlighting

canvas图片操作

阿里云OSS上传文件超时 探测工具排查方法

Lightweight network (1): MobileNet V1, V2, V3 series

dsu on tree(树上启发式合并)学习笔记

idea 方法注释:自定义修改method的return和params,void不显示

持续集成/持续部署(2)Jenkins & SonarQube

训练一个神经网络要多久,神经网络训练时间过长

opencv 制作趣图

大佬们,我有一个MySQL source 通过旁路分流分了两个流,然后转表,现在想sink到两个hb

Redis的客户端连接的可视化管理工具

【wxGlade学习】wxGlade环境配置

Quickly submit a PR (Web) for OpenHarmony in 5 minutes