当前位置:网站首页>torch.stack()的官方解释,详解以及例子

torch.stack()的官方解释,详解以及例子

2022-08-09 10:42:00 【模糊包】

可以直接看最下面的【3.例子】,再回头看前面的解释

在pytorch中,常见的拼接函数主要是两个,分别是:

stack()cat()

实际使用中,这两个函数互相辅助,使用场景不同:关于cat()参考torch.cat(),但是本文主要说stack()。

函数的意义:使用stack可以保留两个信息:[1. 序列] 和 [2. 张量矩阵] 信息,属于【扩张再拼接】的函数。

形象的理解:假如数据都是二维矩阵(平面),它可以把这些一个个平面按第三维(例如:时间序列)压成一个三维的立方体,而立方体的长度就是时间序列长度。

该函数常出现在自然语言处理(NLP)和图像卷积神经网络(CV)中。

1. stack()

官方解释:沿着一个新维度对输入张量序列进行连接。 序列中所有的张量都应该为相同形状。

浅显说法:把多个2维的张量凑成一个3维的张量;多个3维的凑成一个4维的张量…以此类推,也就是在增加新的维度进行堆叠。

outputs = torch.stack(inputs, dim=?) → Tensor

参数

inputs : 待连接的张量序列。

注:python的序列数据只有list和tuple。dim : 新的维度, 必须在

0到len(outputs)之间。

注:len(outputs)是生成数据的维度大小,也就是outputs的维度值。

2. 重点

- 函数中的输入

inputs只允许是序列;且序列内部的张量元素,必须shape相等

----举例:[tensor_1, tensor_2,..]或者(tensor_1, tensor_2,..),且必须tensor_1.shape == tensor_2.shape

dim是选择生成的维度,必须满足0<=dim<len(outputs);len(outputs)是输出后的tensor的维度大小

不懂的看例子,再回过头看就懂了。

3. 例子

1.准备2个tensor数据,每个的shape都是[3,3]

# 假设是时间步T1的输出

T1 = torch.tensor([[1, 2, 3],

[4, 5, 6],

[7, 8, 9]])

# 假设是时间步T2的输出

T2 = torch.tensor([[10, 20, 30],

[40, 50, 60],

[70, 80, 90]])

2.测试stack函数

print(torch.stack((T1,T2),dim=0).shape)

print(torch.stack((T1,T2),dim=1).shape)

print(torch.stack((T1,T2),dim=2).shape)

print(torch.stack((T1,T2),dim=3).shape)

# outputs:

torch.Size([2, 3, 3])

torch.Size([3, 2, 3])

torch.Size([3, 3, 2])

'选择的dim>len(outputs),所以报错'

IndexError: Dimension out of range (expected to be in range of [-3, 2], but got 3)

可以复制代码运行试试:拼接后的tensor形状,会根据不同的dim发生变化。

| dim | shape |

|---|---|

| 0 | [2, 3, 3] |

| 1 | [3, 2, 3] |

| 2 | [3, 3, 2] |

| 3 | 溢出报错 |

4. 总结

函数作用:

函数stack()对序列数据内部的张量进行扩维拼接,指定维度由程序员选择、大小是生成后数据的维度区间。存在意义:

在自然语言处理和卷及神经网络中, 通常为了保留–[序列(先后)信息] 和 [张量的矩阵信息] 才会使用stack。

函数存在意义?》》》

手写过RNN的同学,知道在循环神经网络中输出数据是:一个list,该列表插入了seq_len个形状是[batch_size, output_size]的tensor,不利于计算,需要使用stack进行拼接,保留–[1.seq_len这个时间步]和–[2.张量属性[batch_size, output_size]]。

边栏推荐

猜你喜欢

随机推荐

学习NET-SNMP之一 ---------编译NET-SNMP程序。

笔记本电脑使用常见问题,持续更新

判断一段文字的width

Shell script combat (2nd edition) / People's Posts and Telecommunications Press Script 1 Find programs in the PATH

Mysql多表查询

强化学习 (Reinforcement Learning)

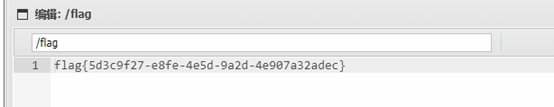

浅析JWT安全问题

使用.NET简单实现一个Redis的高性能克隆版(四、五)

Oracle数据库:for update 和for update nowait的区别

如何在gazebo进行 joint的转动控制

autogluon安装,使用指南,代码

shell脚本实战(第2版)/人民邮电出版社 脚本2 验证输入:仅限字母和数字

TELNET协议相关RFC

MySQL备份与恢复

基于STM32设计的环境检测设备

深度学习--生成对抗网络(Generative Adversarial Nets)

unix环境编程 第十五章 15.5FIFO

Solve the ali cloud oss - the original 】 【 exe double-click response can't open, to provide a solution

单元测试2之实际结果检查的引用

How to quickly get through the mirror release process?