当前位置:网站首页>5分钟NLP:Text-To-Text Transfer Transformer (T5)统一的文本到文本任务模型

5分钟NLP:Text-To-Text Transfer Transformer (T5)统一的文本到文本任务模型

2022-04-23 16:25:00 【deephub】

本文将解释如下术语:T5,C4,Unified Text-to-Text Tasks

迁移学习在NLP中的有效性来自对具有自监督任务的丰富无标记的文本数据进行预训练的模型,例如语言建模或填写缺失的单词。 通过预先训练后,可以在较小的标记数据集上微调模型,通常比单独使用标记的数据训练更好的性能。迁移学习被诸如GPT,Bert,XLNet,Roberta,Albert和Reformer等模型所证明。

Text-To-Text Transfer Transformer (T5)

该论文“Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer”(2019年出版)提出了一项大规模的经验调查,展示了哪种迁移学习技术最有效,并应用这些见解创建新的被称为Text-To-Text Transfer Transformer (T5)模型。

迁移学习的重要部分是用于预训练的未标记数据集,这不仅应该是高质量和多样化的,而且还应该是大量。以前的预训练数据集并不符合所有这三个标准,因为:

- Wikipedia的文字高质量,但风格均匀,适合我们的目的相对较小

- 来自Common Crawl Web抓取的文字是巨大的,高度多样,但质量相对较低。

所以论文中开发了一个新的数据集: Colossal Clean Crawled Corpus (C4),这是一个Common Crawl 的“清洁”版本,比维基百科大两个数量级。

在C4上预先训练的T5模型可在许多NLP基准上获得最先进的结果,同时足够灵活,可以对几个下游任务进行微调。

对文本到文本格式进行统一

使用T5,所有NLP任务都可以被转换为统一的文本到文本格式,任务的输入和输出始终是文本字符串。

该框架提供了一致的训练目标,用于预训练和微调。 无论任务如何,该模型都具有最大似然目标。 如果要指定模型应该哪一类的任务,需要在将其送到模型之前将任务的目标标识.作为特定的文本前缀添加到原始输入序列中。

这个框架允许在任何NLP任务上使用相同的模型、损失函数和超参数,例如机器翻译、文档摘要、问答和分类任务。

比较不同的模型和训练策略

T5的论文提供了多种模型架构,预训练目标,数据集,训练策略和规模水平的比较。对比的基线模型是标准编码器解码器Transformer。

- 模型架构:虽然一些关于NLP的迁移学习的工作已经考虑了Transformer的架构变体,但原始的编码器 - 解码器形式在具有文本到文本框架的实验中可以完美的工作。

- 预训练目标:大多数去噪目标训练模型会重建随机损坏的文本,在T5的设置中也是执行类似的操作。因此,建议使用无监督的预训练来增加计算效率,例如填补空白的剥夺目标。

- 未标记的数据集:域内数据的训练可能是有益的,但小型数据集的预训练可能导致有害的过拟合,特别是当数据集足够小时,在预训练过程中重复多次。这促使人们使用像C4这样的大型和多样化的数据集来完成通用语言理解任务。

- 训练策略:在训练任务后进行微调,可以为无监督的预训练产生了很好的性能提升。

- 规模水平缩放:比较了利用额外计算的各种策略,包括更多数据,更大的模型,并使用模型的整合。每种方法都可以得到性能的提升,但是用更多的数据训练一个较小的模型,往往比用更少的步骤训练一个较大的模型更好。

结果表明,文本文本方法成功应用于生成任务(例如,抽象摘要),分类任务(例如自然语言推断),甚至是回归任务,对任务特定的架构和状态都有相当的性能 。

最终的T5模型

结合实验的见解,作者用不同的维度(多达110亿个参数)训练模型,并在许多基准测试中实现最先进的结果。这些模型是在C4数据集上预先训练的,然后在对单个任务进行微调之前,在多任务混合上进行预训练。

最大的模型在GLUE, SuperGLUE, SQuAD, and CNN/Daily Mail 等测试中达到了最先进的结果。

总结

在本文中,介绍了Text-To-Text Transfer Transformer (T5)模型和 Colossal Clean Crawled Corpus (C4)数据集。 同时介绍了不同任务的例子,这被被称为统一的文本到文本任务,并看到具有不同模型架构和训练策略的性能定性实验结果。

如果你对这个感兴趣,可以自己尝试下下面的工作:

- 了解T5模型的后续改进,如T5v1.1(具有一些架构调整的T5的改进版),MT5(多语言T5模型)和BYT5(在字节序列上预先培训的T5模型而不是 令牌 序列)

- 可以看看Hugging Face的T5实现并且进行微调

https://www.overfit.cn/post/a0e9aaeaabf04087a278aea6f06d14d6

作者:Fabio Chiusano

版权声明

本文为[deephub]所创,转载请带上原文链接,感谢

https://deephub.blog.csdn.net/article/details/124359485

边栏推荐

- Download and install mongodb

- Master vscode remote GDB debugging

- Qipengyuan horizon credible meta universe social system meets diversified consumption and social needs

- Filter usage of spark operator

- Es common query, sorting and aggregation statements

- Sortby use of spark operator

- Win11/10家庭版禁用Edge的inprivate浏览功能

- RecyclerView advanced use - to realize drag and drop function of imitation Alipay menu edit page

- Grbl learning (I)

- Review 2021: how to help customers clear the obstacles in the last mile of going to the cloud?

猜你喜欢

Sail soft segmentation solution: take only one character (required field) of a string

299. Number guessing game

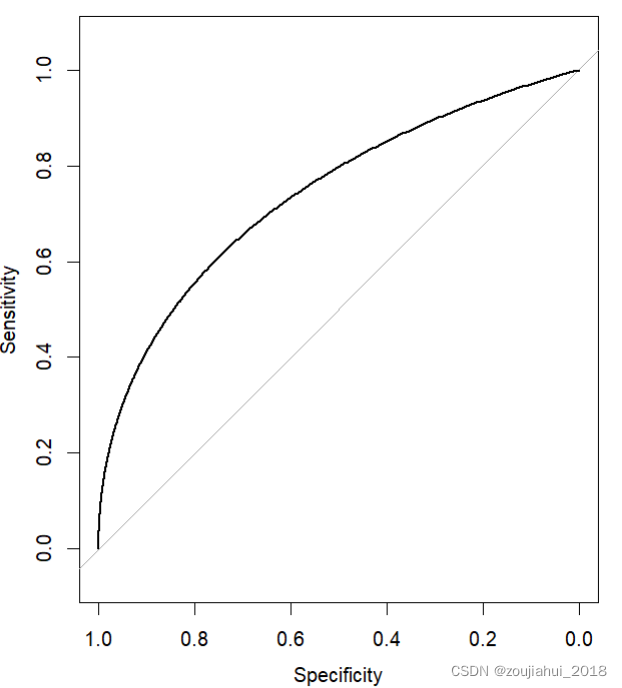

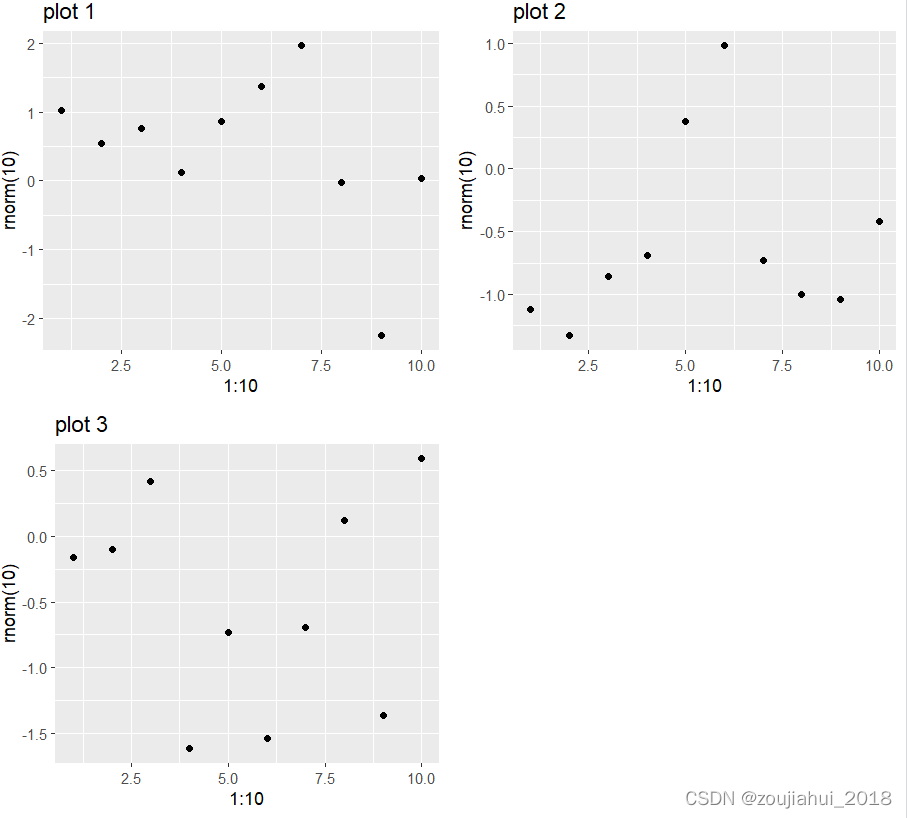

Method 2 of drawing ROC curve in R language: proc package

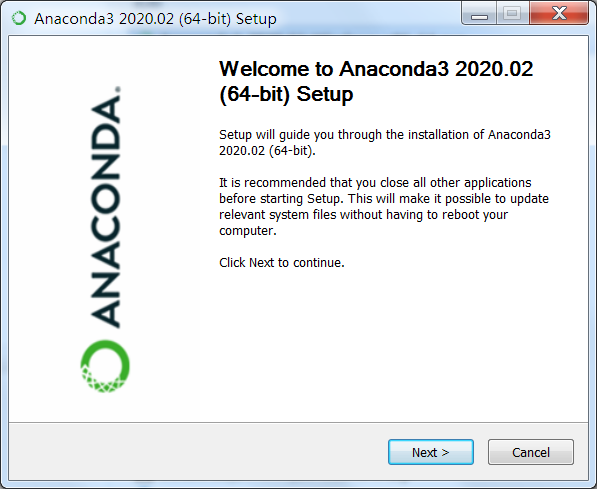

Nanny Anaconda installation tutorial

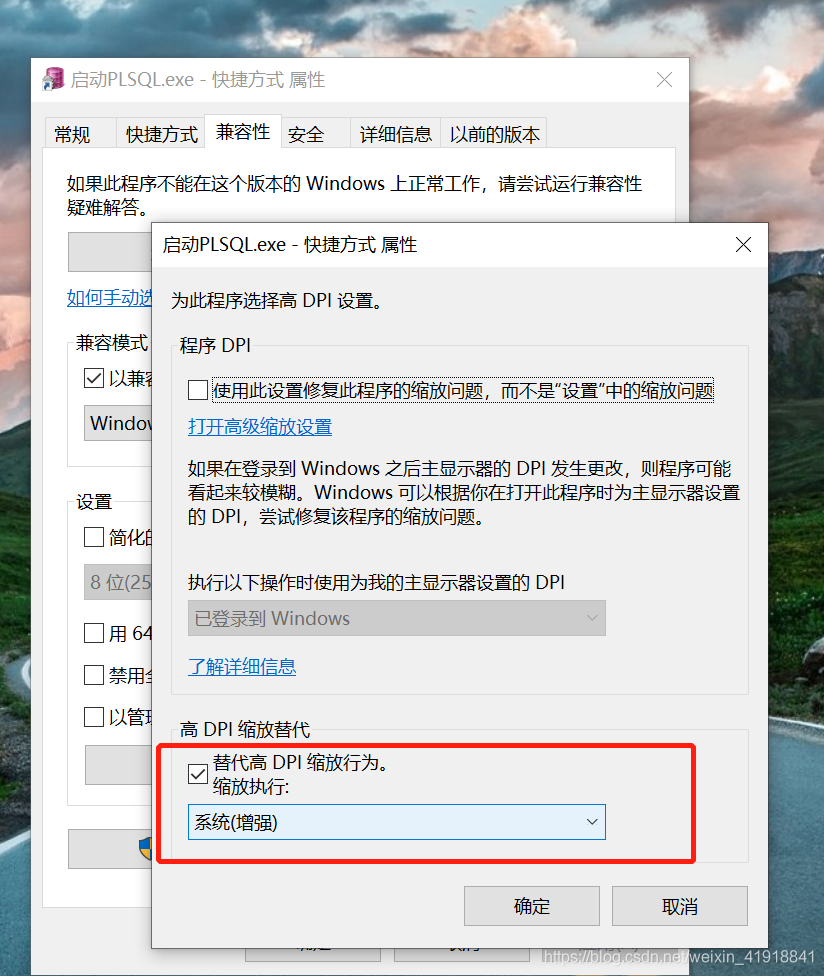

Change the icon size of PLSQL toolbar

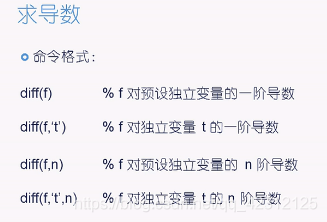

Day (7) of picking up matlab

5 minutes, turn your excel into an online database, the magic cube net table Excel database

Function summary of drawing object arrangement in R language

The system research problem that has plagued for many years has automatic collection tools, which are open source and free

Best practice of cloud migration in education industry: Haiyun Jiexun uses hypermotion cloud migration products to implement progressive migration for a university in Beijing, with a success rate of 1

随机推荐

05 Lua control structure

What does cloud disaster tolerance mean? What is the difference between cloud disaster tolerance and traditional disaster tolerance?

Using JSON server to create server requests locally

力扣-746.使用最小花费爬楼梯

Six scenarios of cloud migration

On the value, breaking and harvest of NFT project

MySQL - MySQL查询语句的执行过程

Intersection, union and difference sets of spark operators

浅谈 NFT项目的价值、破发、收割之争

The most detailed knapsack problem!!!

Day (4) of picking up matlab

How magical is the unsafe class used by all major frameworks?

撿起MATLAB的第(9)天

ESXi封装网卡驱动

安装Redis并部署Redis高可用集群

MySQL的btree索引和hash索引区别

04 Lua 运算符

Homewbrew installation, common commands and installation path

Cloud migration practice in the financial industry Ping An financial cloud integrates hypermotion cloud migration solution to provide migration services for customers in the financial industry

Leetcode-374 guess the size of the number